谷歌推出语音操控UI工具Stitch,设计师靠说话就能改界面

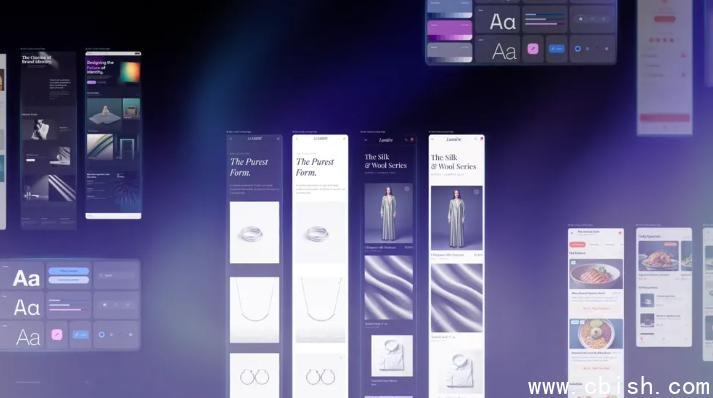

谷歌最近为旗下的AI设计工具Stitch上线了一项新功能:你只需要开口说话,就能直接修改应用界面。不用写一行代码,也不用在Figma里拖拽像素,只要说“把按钮颜色调得温柔一点”“让卡片看起来更暖和”,Stitch就能自动调整颜色、阴影、间距,甚至生成对应的代码。

这个功能不是概念演示,目前已经向部分开发者开放测试。不少早期使用者反馈,原本需要半小时调整的视觉细节,现在三句话就搞定了。一位独立开发者在社交媒体上分享:“我昨晚给App加了个‘睡前模式’,说‘背景变暗、字体软一点、别那么冷’,它真给我做出来了,比我想象的还舒服。”

不是AI在“猜”,是它在听懂人的感觉

过去,设计师和工程师之间总隔着一层“术语墙”:设计师说“这个页面有点冷”,工程师问“是色温低?还是对比度太高?”。现在,Stitch尝试直接打通这层隔阂。它不依赖预设模板,也不靠关键词匹配,而是通过长期学习大量设计作品和用户反馈,建立起对“氛围”的理解。

比如你说“想要像星巴克下午三点那种感觉”,它会调低饱和度、增加轻微毛玻璃效果、把按钮圆角调得更饱满——不是因为系统里有“星巴克模板”,而是它从成千上万张真实界面中,总结出这类视觉风格的共同特征。

这项能力对非技术背景的创意人员尤其友好。一位插画师用Stitch为自己的数字画廊网站做原型,全程没碰过CSS:“我边画边说,‘这里加点呼吸感’‘字体别那么正经’,它居然懂。”

有人狂赞,也有人摇头

支持者认为,这真正让设计回归了“表达”本身。在快节奏的创业公司里,原型迭代速度决定生死。以前一个按钮改颜色要走流程、排期、写需求文档,现在一句话,当天就能上线测试。

但质疑声也不少。有资深前端工程师指出:“你能让AI做‘温暖感’,那谁来保证按钮点击区域足够大?谁来确保色盲用户能看清文字?”他担心,当所有人都用“感觉”来设计,产品会越来越像——同样的柔和色调、同样的圆角、同样的留白,最终变成千篇一律的“AI审美”。

也有设计师担心,工具越方便,人越懒。过去我们为一个阴影值争论半小时,是因为我们在思考用户情绪;现在AI一键搞定,我们会不会连思考都省了?

这不是未来,是正在发生的改变

谷歌没有宣称Stitch会取代设计师,但它确实在重新定义“谁可以做设计”。过去,只有懂代码的人才能把想法变成真实界面;今天,只要你会说话,就能参与创造。

目前,Stitch的语音功能仍处于灰度测试阶段,仅对部分Google Cloud用户开放。但据内部消息,谷歌正与多家设计平台合作,未来可能接入Figma、Adobe XD等常用工具,让语音操控成为标准操作。

如果你是一名独立开发者、自由设计师,或者只是想快速把脑海里的想法变成可点可滑的界面——也许,你不需要再学代码了。你只需要学会怎么描述你的感觉。