通义实验室开源Fun-CineForge:让AI配音真正“演”起来

3月16日,阿里通义实验室正式开源了一款专为影视级配音打造的多模态大模型——Fun-CineForge。这不是又一个能念稿子的语音合成工具,而是一个能“看懂画面、听懂情绪、对准口型”的配音助手。它解决了长久以来AI配音最让人出戏的三个问题:嘴动声音没跟上、情绪平淡像机器人、多个角色声音一个调。

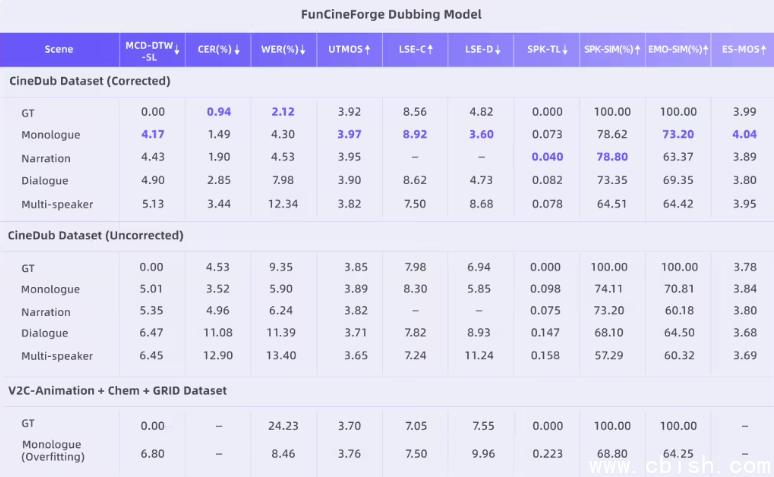

过去,AI配音靠的是“文本→语音”的单向映射,画面、动作、节奏全靠猜。Fun-CineForge不一样——它第一次把“时间”当成一种独立的模态来处理。什么意思?就是模型能精确知道:人物在第3秒张嘴,第5秒抬头,第7秒笑出声,语音必须在这个时间窗口内精准生成。哪怕镜头突然切到背面,人脸被遮住,或者画面模糊晃动,它依然能根据肢体动作、场景节奏,把声音“钉”在正确的时间点上。实测中,它在复杂剪辑片段里的音画同步准确率超过94%,远超行业平均水平。

数据不是靠人“标”出来的,是模型“自己练”出来的

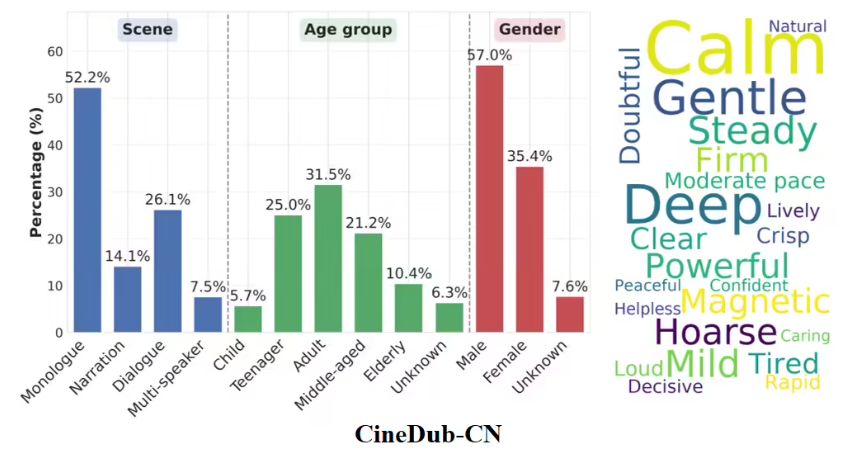

训练这么强的模型,光有算法不够,还得有好数据。传统配音数据集,靠人工逐帧标注口型、说话人、时间戳,一套百集动画下来,成本动辄百万。通义团队另辟蹊径,用大模型思维链技术,把原始影视素材自动“拆解”成结构化训练数据。

流程是这样的:先用模型识别画面中谁在说话、说了什么、什么时候停顿,再结合音频波形和字幕,自动校准错字、分离混杂的对白。结果很惊人:中英文字错率压到1%以下,说话人混淆率仅1.2%——这已经接近专业后期团队的标注水准,但效率提升了几十倍。这个数据构建方法,也一并开源,让更多团队能低成本复用。

不只是单人念台词,双人对戏也能稳住

很多AI配音工具,只擅长一个人静静说话。但影视里最考验人的,是两个人吵架、三个人抢话、甚至群戏里七嘴八舌。Fun-CineForge 是首个在公开模型中,真正支持多角色实时对话配音的系统。它能区分不同角色的语调、语速、呼吸节奏,甚至在对话间隙保留自然的停顿和气息声。

目前模型支持30秒以内的短视频片段推理,已在GitHub、Hugging Face和魔搭社区上线。开发者、独立动画人、短视频创作者,都可以免费下载使用。有人用它给老电影配外语版,有人替B站UP主批量生成配音,还有团队在测试用它为AI生成的虚拟偶像做直播语音——不靠真人,却能让人感觉“这声音是活的”。

这不是AI在模仿人说话,而是在学习人怎么“演”。

现在就能用

项目已全平台开源,无需申请,直接下载:

GitHub: https://github.com/FunAudioLLM/FunCineForge

HuggingFace: https://huggingface.co/FunAudioLLM/Fun-CineForge

ModelScope: https://www.modelscope.cn/models/FunAudioLLM/Fun-CineForge/

如果你正在为配音耗时、成本高、效果假而头疼,这可能是你今年最值得试一试的工具。