黄仁勋重磅发声:OpenClaw 三周爆火,AI 算力革命已至

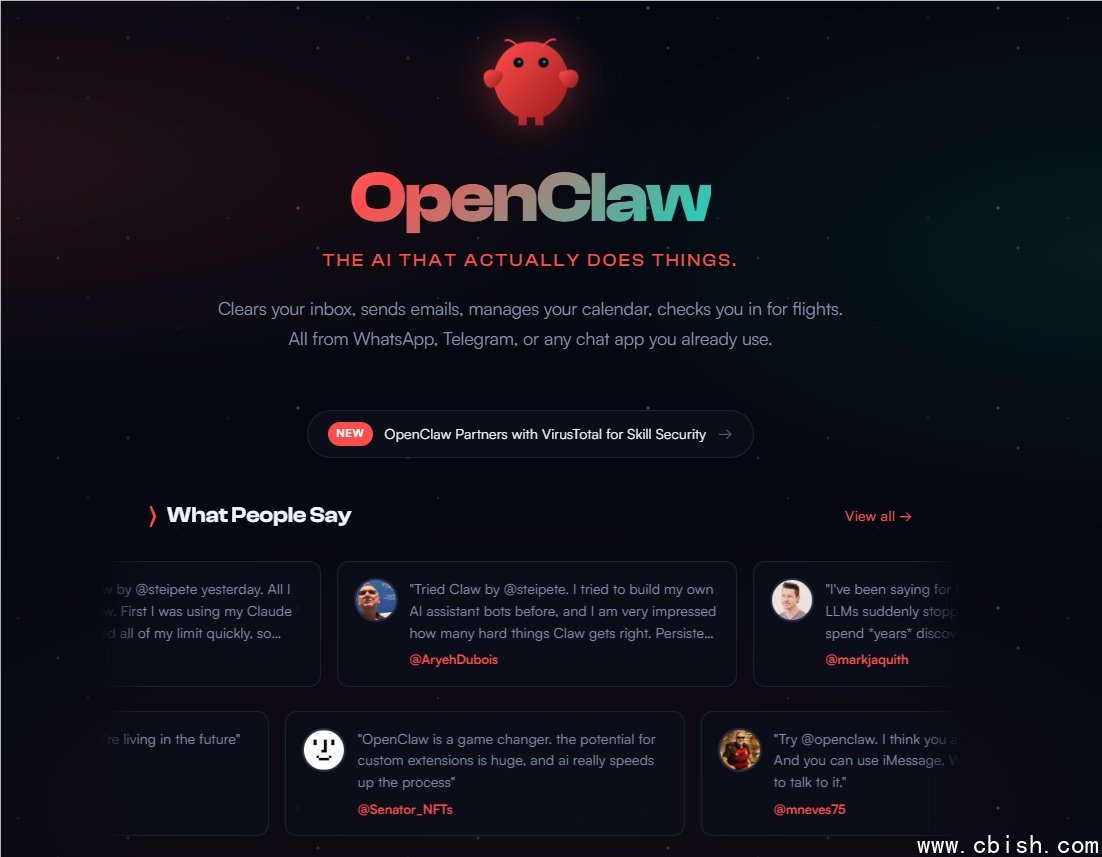

在近日的摩根士丹利科技峰会上,英伟达CEO黄仁勋罕见地用“历史性拐点”来形容当前AI的发展阶段。他点名一个名为OpenClaw的开源项目,称其为“当代最重要的软件发布”,并直言:“我们从未见过一个开源项目,能在三周内颠覆整个行业生态。”

对比Linux操作系统用了近三十年才成为全球基础设施的基石,OpenClaw仅用21天就登顶GitHub下载榜,累计下载量突破1.2亿次,远超此前纪录保持者PyTorch和LangChain。开发者社区中,已有超过500个企业级应用开始集成OpenClaw,覆盖金融风控、法律文书生成、客服自动化、供应链调度等高价值场景。

“五层蛋糕”理论:真正赚钱的,是最后一层

黄仁勋在现场画出了一张“AI产业五层蛋糕”图:

- 最底层是能源——电力供应与绿色转型

- 第二层是芯片与计算硬件——英伟达的根基

- 第三层是云数据中心——AWS、Azure、阿里云的战场

- 第四层是模型——GPT、Claude、Llama等大模型

- 最顶层,是应用——也就是OpenClaw这类“智能体”

“过去十年,大家在比谁的模型更大、参数更多,”他说,“但真正能带来商业回报的,是能直接替代人类工作的应用层。”

OpenClaw之所以引发震动,是因为它不是简单的对话机器人,而是能自主规划任务、调用工具、长期记忆上下文、连续执行多步骤操作的“AI员工”。一个客服智能体,可以连续处理30分钟的客户咨询,中间自动查订单、改地址、发补偿、回访确认,全程无需人工干预。

算力黑洞:1000倍Token消耗,服务器吃不消了

这种“长上下文+自主决策”的能力,带来了前所未有的算力压力。黄仁勋透露,OpenClaw类智能体的Token消耗量,是传统大模型的近1000倍。这意味着,过去一个GPT-4o每小时处理100个请求,现在同样的硬件,只能处理不到0.1个智能体任务。

“我们看到一些客户,一个智能体每天吃掉10万美金的算力。”一位硅谷风投人士私下向媒体表示,“他们不是在跑AI,是在烧钱养AI员工。”

云厂商开始紧急扩容。AWS的EC2 p5实例订单量在OpenClaw发布后一周内暴涨370%,谷歌云的A3超级集群预订排期已延至2025年第三季度。

英伟达的应对:Vera Rubin架构,专为“长脑”而生

面对这场算力饥荒,英伟达正加速下一代GPU架构的研发。黄仁勋首次公开透露,代号“Vera Rubin”的新架构将于2025年Q4量产,专为长上下文智能体优化。

核心改进包括:

- 板载HBM4内存容量提升至288GB,是Hopper架构的近3倍

- 引入ICMS(Integrated Context Memory System)平台,让AI在不频繁访问显存的情况下,持续记住数万条对话记录

- 重新设计推理流水线,减少重复计算,同等任务下能耗降低40%

据接近英伟达的工程师透露,Vera Rubin的首批客户将是亚马逊、微软和字节跳动——三家都在内部测试“AI员工”替代客服、运营、财务等岗位,预计2025年底将有超过10万个AI代理在企业中运行。

现实落地:不是科幻,是正在发生的裁员潮

这不是实验室里的概念。一家总部位于深圳的跨境电商公司,用OpenClaw替换了47名客服人员,月人力成本从83万降至11万,客户满意度反而上升了12%。另一家律所,用智能体自动生成合同初稿、比对历史判例,律师团队从15人缩减到6人,案件处理速度翻倍。

黄仁勋最后说:“我们不再是在创造工具,而是在创造新的劳动力。这不是AI的未来——这是现在。”

市场已用脚投票。OpenClaw GitHub仓库的Star数在72小时内突破20万,开发者自发组建的Discord社群人数已超45万。有人调侃:“Linux教会了我们怎么建网络,OpenClaw正在教我们怎么不用人。”