DeepSeek V4Lite:2000亿参数,却让全球AI圈重新看中国模型

还没等到DeepSeek V4完整版官宣,它的“小弟”DeepSeek V4Lite已经悄悄成了开发者圈子里的热门话题。2月中旬刚发布时,大家只注意到它支持100万token的超长上下文——这在当时确实亮眼,但没人觉得它能掀翻什么风浪。毕竟,参数比它大的模型多了去了,谁也没把它当真。

可到了2月底,事情开始不对劲了。

一位在GitHub上做前端开源项目的开发者,用V4Lite替换了他原本用的Claude 3.5 Sonnet,结果发现:写React组件的逻辑更顺了,CSS样式更贴近设计稿,连注释都写得像真人一样有温度。他没发帖,只是在群里悄悄说了一句:“这玩意儿,是不是偷偷吃了药?”

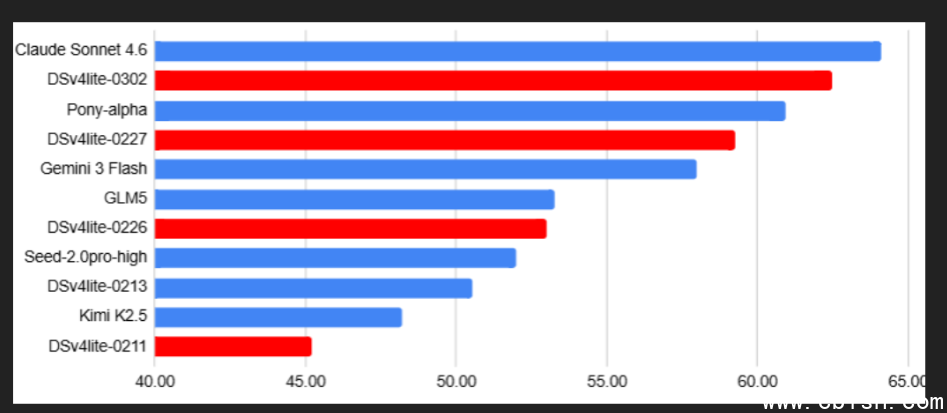

这句话像病毒一样传开。紧接着,几个独立测试陆续出现:在HumanEval编程基准上,V4Lite的得分超过GPT-4o;在MMLU综合知识测试里,它稳居国产模型第一;在对中文诗歌、广告文案、UI交互描述的理解上,甚至有人觉得它比某些国外闭源模型更懂“人味儿”。

最让人意外的是,它不是靠堆算力赢的。2000亿参数,在如今动辄7000亿、上万亿的模型里,简直像一辆小排量车跑出了超跑的加速。没有海量训练集群,没有谷歌、OpenAI那样的数据池,DeepSeek靠的是怎么把每一行代码、每一个参数都用到极致——有人说是“精打细算”,也有人说,这是中国团队在限制中练出的真本事。

它不是在“追赶”,是在重新定义“够用”

过去几年,国产大模型总被贴上“能用但不够好”的标签——编程差一点、数学弱一点、审美没感觉。但V4Lite打破了这种刻板印象。

一个做AI绘图提示词优化的设计师,用它生成了50组电商详情页文案,最终选中的8条,全被客户直接采用,连修改都省了。她说:“它不是在复述,它是在理解我的品牌。”

一个独立开发者用它搭建了一个自动改Bug的工具,只花了三天。他原本以为要买GPT-4 API,结果发现V4Lite本地跑得比云端还稳,响应快、不卡顿、不收费。他把代码开源了,一周内星标破万。

更关键的是,它不装。没有花哨的演示视频,没有发布会,没有营销话术。所有的进步,都藏在版本号里:0228 → 0302 → 0310。每次更新,社区里都有人跑一次测试,然后默默发一句:“又强了。”

真正的期待,是V4完整版

如果一个“轻量版”都能做到这个地步,那完整版的DeepSeek V4,到底会是什么样?

有内部消息说,V4的训练数据量是V4Lite的三倍以上,多模态能力已内嵌,支持图像、表格、代码混合输入。还有人透露,它在Agent任务中的规划能力,已经能独立完成“从需求文档到上线网页”的全流程——不是模拟,是真跑通了。

目前,V4Lite已在Hugging Face、ModelScope等平台开源,支持本地部署,不少中小企业和开发者已经开始用它替代商业API。有人算了一笔账:用V4Lite跑业务,成本不到GPT-4的1/10,效果却接近。

这不是一场技术秀,而是一次沉默的反击。

当全世界都在比谁的参数更大、谁的算力更强时,DeepSeek选择了一条更难的路:用最少的资源,做出最贴近真实需求的模型。它不追求“世界第一”,它只想让每一个普通开发者,都能用上真正好用的AI。

现在,所有人都在等——

那个还没露面的V4,会不会直接改写全球AI的规则?