Adobe Character Animator:实时动画制作的革命性工具

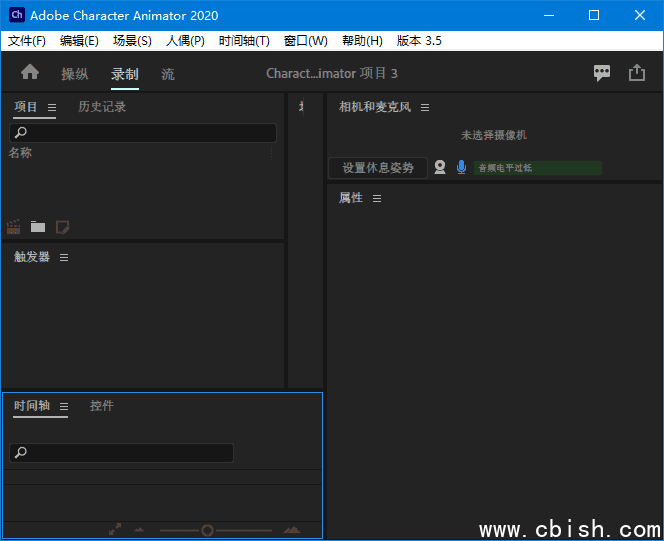

Adobe Character Animator(简称“Character Animator”或“CHA”)是Adobe Systems推出的一款创新性动画创作软件,作为Adobe Creative Cloud创意云套件的重要组成部分,它为动画师、内容创作者和教育工作者提供了一种前所未有的方式——通过摄像头和麦克风实时捕捉用户的面部表情与声音,驱动2D角色进行生动表演。无论是制作网络视频、教学动画,还是直播虚拟形象,Character Animator都能显著提升创作效率,降低传统逐帧动画的时间成本。

核心功能:让角色“活”起来

Character Animator的最大亮点在于其实时驱动能力。用户只需打开摄像头和麦克风,软件即可通过人脸识别技术捕捉眨眼、张嘴、皱眉等面部动作,并实时映射到预先设计好的2D角色上。同时,语音输入还能自动触发口型同步(Lip Sync),让角色说话时的嘴型与声音完美匹配,省去手动调整的繁琐流程。

此外,软件支持骨骼绑定、层级结构控制和行为系统,用户可通过键盘快捷键或MIDI设备操控角色的肢体动作、切换表情或触发特定动画片段。配合Adobe Photoshop和Illustrator,用户可直接导入PSD或AI文件,保留图层结构,实现跨平台无缝协作。完成后的动画还可一键导出至Adobe After Effects进行后期合成,极大提升了专业工作流的连贯性。

适用人群与应用场景广泛

Character Animator深受YouTuber、在线教育讲师、社交媒体内容创作者以及独立动画人的青睐。例如,许多知识类博主使用它创建虚拟讲师形象,增强课程趣味性;游戏主播则利用其打造个性化的虚拟化身(VTuber风格),提升直播间互动体验。在教育领域,教师可以设计卡通角色讲解知识点,吸引学生注意力,提高学习参与度。

值得一提的是,该软件对硬件要求相对较低,普通笔记本电脑配备基础摄像头即可运行,适合个人创作者和小型团队快速上手。同时,Adobe官方提供了丰富的模板库和教程资源,帮助新手在短时间内掌握核心操作。

版本更新与技术支持

自2016年首次发布以来,Adobe持续为Character Animator引入新功能。近年来的版本(如2022至2024年更新)增强了对多角色场景的支持、改进了物理引擎(如布娃娃系统)、优化了音频响应精度,并提升了与After Effects和Premiere Pro的动态链接性能。尽管目前Adobe尚未推出完全基于AI驱动的自动动画生成系统,但其在实时交互与人性化控制方面的表现已处于行业领先水平。

需要注意的是,文中提及的“免激活版”或“破解版”属于非官方修改版本,存在安全风险(如恶意软件、数据泄露)且违反Adobe软件许可协议。建议用户通过正规渠道订阅Adobe Creative Cloud服务,以获得稳定更新、云存储支持及官方技术支持,确保创作环境的安全与合规。

未来展望:虚拟内容创作的新常态

随着虚拟现实、元宇宙概念的兴起,实时动画工具的重要性日益凸显。Adobe Character Animator正逐步成为数字角色创作生态中的关键一环。未来,结合AI表情预测、动作迁移技术和更智能的自动绑定功能,该软件有望进一步降低动画制作门槛,让更多非专业人士也能轻松创作出富有表现力的动画内容。