百灵大模型开源Ring-2.6-1T:真正能干活的AI,来了

今天,百灵大模型正式开源了他们的新一代旗舰模型 Ring-2.6-1T —— 一个参数规模突破万亿、专为“做事情”而生的AI系统。它不只擅长聊天,更擅长写代码、跑实验、调系统、拆解复杂任务,甚至能自己查资料、改bug、再汇报结果。如果你厌倦了AI只会“说”不会“做”,那这次的更新,可能正是你一直在等的那一步。

不是参数越大越好,而是能解决真实问题

过去几年,大模型的竞赛一直在比谁参数更多、谁的对话更流畅。但开发者真正头疼的,是模型在真实场景里“说起来头头是道,一动手就掉链子”——比如让你写个自动化脚本,它能讲出五种方案,但就是跑不通;让你分析一份日志,它能总结出十点原因,但找不到关键错误。

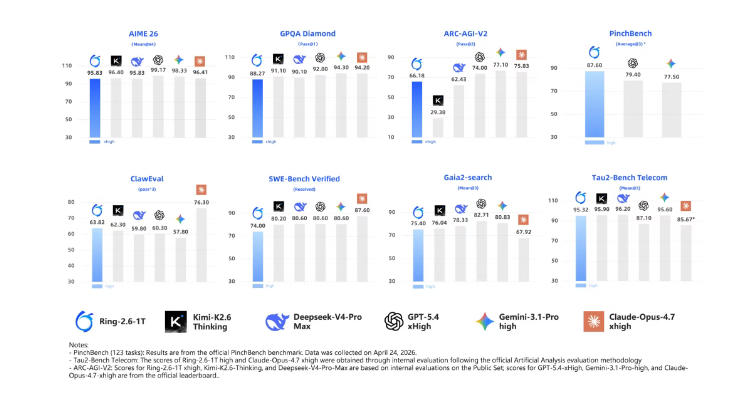

Ring-2.6-1T 的目标很直接:让AI真正能“交付结果”。它在 PinchBench 和 ClawEval 这两个业内公认的Agent任务评估平台上,表现超越了所有已开源模型。这意味着它不仅能理解你要做什么,还能一步步拆解、调用工具、修正错误,直到完成任务。不是“看起来聪明”,而是“真的能上手干活”。

推理强度可调,省算力、不浪费

训练一个万亿参数模型成本极高,但不是每个任务都需要“全功率运行”。Ring-2.6-1T 引入了一个实用功能:你可以手动选择“推理强度”——

- High 模式:适合日常开发、运维、数据处理。在电信业务测试(Tau2-Bench)中,它的准确率和响应速度都优于同类模型,日常使用完全够用,资源消耗也可控。

- XHigh 模式:留给真正硬核的问题——比如解数学竞赛题(AIME26)、回答专业级科学问题(GPQA Diamond)。这时候它会像一个加班到深夜的资深研究员,反复推演、交叉验证,直到给出最可靠的答案。

你不用每次都“开全速”,省下的算力,就是省下的钱。

训练稳定了,才敢开源

万亿参数模型训练起来像开一艘巨型油轮——稍有不慎就偏航、熄火、甚至报废。百灵团队没用传统方法,而是结合了异步强化学习和他们自研的“棒冰算法”(BingBing Algorithm),让训练过程像“慢火炖汤”一样稳得住。这不仅降低了训练失败率,也让模型在长时间运行中保持一致性。

这不是炫技,而是开源的前提。他们知道,一旦把模型放出去,开发者会拿它跑7×24小时的自动化流水线。如果模型动不动就“发呆”或“胡说八道”,没人敢用。

现在就能用,但别指望它完美

Ring-2.6-1T 的权重已经开放在 Hugging Face 和 ModelScope,任何人都可以下载、部署、改造。团队也坦诚:它在处理“超长任务链”(比如连续十步以上的跨系统操作)时,偶尔还会“断片”或记错上下文。这不是终点,而是起点。

但这次开源的意义,远不止一个模型。它标志着AI正从“聊天机器人”变成“数字助手”——能理解你的意图,能调用你的工具,能独立完成任务,甚至能告诉你“这步我做不了,建议你手动处理一下”。

如果你是开发者、数据工程师、科研人员,或者只是想让AI帮你自动跑个脚本、整理实验数据、写个部署文档——现在,你可以真正试一试了。它不完美,但它在认真做事。