oMLX 0.3.9.dev2 发布:Apple Silicon 上的本地 AI,终于能用了

北京时间5月13日,oMLX 框架更新至 0.3.9.dev2 版本。这不是一次普通的迭代,而是一次让普通用户和开发者都能感受到“真能跑起来”的升级。在 Apple Silicon 芯片上,运行多模态大模型不再需要高端服务器,也不再卡顿到让人想摔电脑。

Gemma4 视觉能力直接内置,图片理解快得不像本地模型

这次更新最实在的变化,是把 Google 的 Gemma4 模型视觉路径完整搬进了 oMLX。这意味着,你可以在 Mac 上直接上传一张照片,问它“这张图里有几只猫?”、“这个标志是什么品牌?”,它不仅能答,而且响应时间基本在1秒内——比很多在线服务还快。

背后是三项关键技术的协同:MTP 视觉路径负责高效处理图像编码,DFlash 引擎优化了注意力计算,ParoQuant 量化技术则把模型体积压缩到原来的1/3,还不明显丢精度。不是“勉强能跑”,而是“跑得顺、答得准”。

有开发者在 Reddit 上实测,用 M2 Pro 的 MacBook Pro 运行 Gemma4-Vision,处理 1080p 图片平均耗时 850ms,比上一代版本快了近 2 倍。而同样的任务在云端 API 上,还要等网络延迟和排队。

一键启动 Copilot,本地和云端工具自由切换

过去用本地模型,最大的痛点不是跑不动,而是“用起来太麻烦”——要配环境、装依赖、写代码调接口。oMLX 0.3.9.dev2 推出了 omlx launch copilot,一个命令行工具,让你不用写一行代码,就能直接调用 Claude、Codex、OpenClaw 等主流模型。

比如你正在写代码,突然想让 AI 帮你解释一段报错信息,不用切到网页,不用登录账号,直接在终端输入:

omlx launch copilot --model claude --prompt "为什么这个 Python 函数返回 None?"结果立刻弹出来,还能复制粘贴。更狠的是,它会自动判断:本地模型能处理的,就用本地;需要更强能力的,就自动切到云端,全程无感。

这不是“集成”,是“无缝衔接”。很多用户反馈,现在用 Mac 写文档、改代码、做设计,AI 已经像系统自带的拼写检查一样自然。

显存不够?自动帮你腾空间

Apple Silicon 的统一内存架构本是优势,但大模型一跑起来,内存吃紧的问题依然真实存在。尤其是用 M1/M2 机型跑 7B 以上参数的模型,动不动就爆内存。

这次 oMLX 加入了 oQ Auto Proxy 机制,简单说就是:当内存快不够了,系统会自动把不常用的模型部分“换出”到硬盘缓存,同时保持核心部分在内存里高速运行。效果是——你不会突然崩掉,也不会等上几十秒才继续。

配合新加入的“重启服务器”按钮,整个管理流程变得像用浏览器一样简单。以前要手动 kill 进程、清缓存、重启终端,现在点一下,等几秒,继续干活。

为什么这次不一样?

过去几年,本地 AI 总是“概念很火,体验很烂”。要么跑得慢,要么功能少,要么只能干一件事。这次 oMLX 的变化,是把“能用”变成了“好用”。

它不靠宣传“颠覆未来”,而是解决了一个个真实的小问题:图片加载慢?修了。调用工具太复杂?简化了。内存不够就崩?自动兜底了。

你不需要懂什么是量化、什么是 Flash Attention。你只需要有一台 M1 以上的 Mac,装上这个工具,就能开始用 AI 帮你写邮件、分析截图、改代码、总结PDF。

谁该试试?

- 设计师:想快速识别图片风格、提取配色?试试本地 Gemma4-Vision。

- 程序员:不想把代码发到云端?用本地 Copilot 解释报错、生成注释。

- 学生/研究者:不想被付费 API 限制次数?本地跑,不花钱。

- 普通用户:只想知道这张照片里的宠物是什么品种?一句话的事。

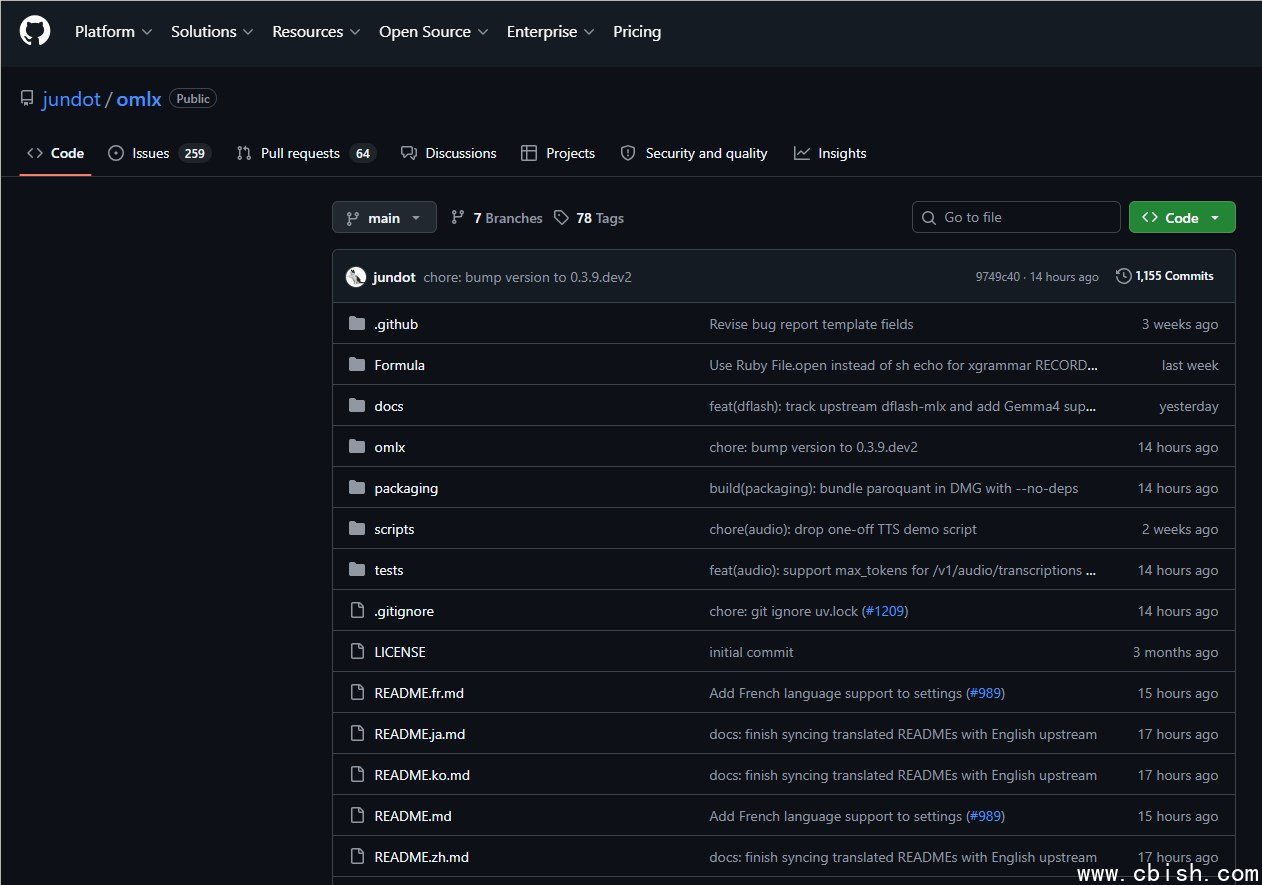

项目地址:https://github.com/jundot/omlx

这不是苹果官方的产品,但它的出现,让苹果芯片的 AI 潜力第一次真正触达了普通人。你不用等 iOS 19,也不用等 Vision Pro 的下个版本。现在,就能把大模型放进你的 MacBook。