从“看懂图”到“做决定”:视觉智能的真正转折点

十年前,计算机视觉的目标很单纯:让机器认出图片里是猫还是狗。ImageNet上准确率每提高1%,都是里程碑。但今天,顶尖模型在标准测试集上已经接近95%以上——再往上,每提升0.1%都要付出十倍的算力。人们开始意识到,光“看得准”已经不够了。真正的突破,不在识别多少类物体,而在能不能在真实世界里“用眼睛做事”。

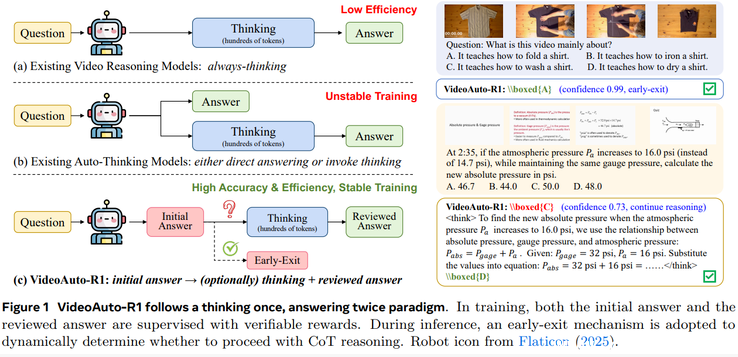

去年CVPR上,一个叫VideoAuto-R1的系统让很多人眼前一亮。它不总在“思考”。看到一张日常餐桌照片,它直接说“有咖啡杯和面包”;但要是问“如果我把牛奶打翻,谁会最先注意到?”,它才启动复杂推理。结果呢?回答变短了3倍多,速度更快,还更像人——我们也不会对每件事都长篇大论地分析。

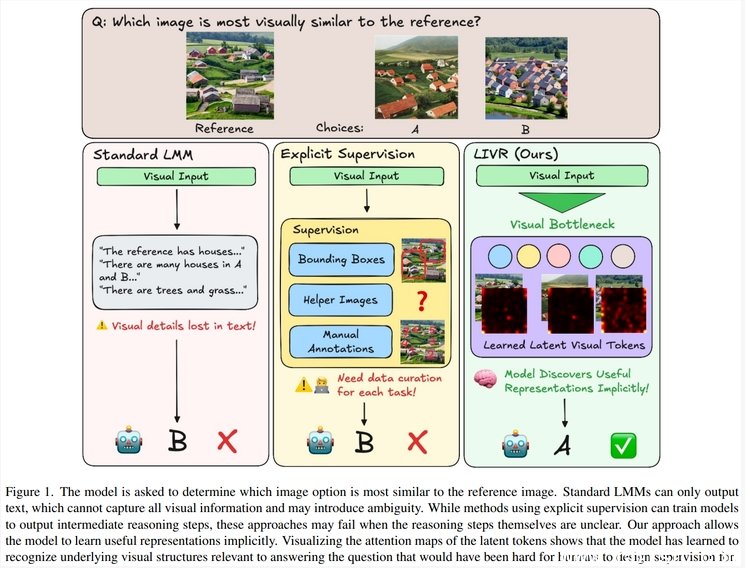

过去,模型总要把视觉信息“翻译”成文字才能推理,比如“左边是红球,右边是蓝方块”。但人类看拼图时,不会在脑子里念叨这些词——我们是直接在脑子里旋转、匹配。现在,像VisuoMind这样的新架构,让模型在“图像的内部表示”里直接操作空间关系,就像大脑的视觉皮层那样工作。结果是,它能更自然地理解三维结构、物体遮挡、动态轨迹,甚至能预测一个滚动的球会撞到哪堵墙。

别再用选择题考AI了

现在的视觉AI测试,90%还是选择题:图里有几只狗?A.1 B.2 C.3。但问题来了——模型根本不用“看懂”,光靠选项分布、词频规律就能猜对。MIT和斯坦福联合做了一项实验:把同一个问题改成开放问答,模型正确率直接从78%掉到56%。这不是“退步”,是揭了老底。

新一批评测标准正在崛起。比如VS-Bench,不让你选答案,而是让你描述一个多人协作的厨房场景:谁在洗碗?谁在偷吃?谁该被提醒?模型得理解意图、情绪、动作序列,甚至预测下一步行为。这不是“认图”,是“看人”。

更狠的是,有些团队开始用真实视频做测试——不是精心剪辑的实验室片段,而是YouTube上普通人拍的厨房混乱、儿童玩耍、宠物捣乱。模型得在噪声、遮挡、光线突变中找出关键信息。这就像让AI去参加真人秀,而不是做模拟考。

开源不是口号,是真把底牌亮出来

以前说“开源”,顶多放个权重文件。现在不一样了。Molmo2不仅把模型参数全公开,连训练用的每一帧视频、标注过程、数据清洗规则都挂到了GitHub上。你甚至能复现它怎么学会“指出图片里咖啡渍的具体像素位置”——不是笼统说“有污渍”,而是精确到坐标。

这背后,是数据的革命。过去很多图像编辑模型靠的是AI生成的“假图”训练,结果一用到真实照片就翻车。Pico-Banana-400K不一样——这是40万个真实用户上传的多轮编辑记录:有人先删掉背景,再换衣服,最后调色温。系统记录了每一次修改、每一次反馈、每一次“不满意”的重做。这不再是“教AI画画”,是“教AI理解人的意图”。

现在,你让模型“把这张照片里的西装换成格子衬衫”,它不再只是套个模板,而是会考虑光影、褶皱、领口遮挡,甚至根据你之前修改的风格,自动匹配你偏爱的色调。这不是魔法,是数据喂出来的习惯。

未来三年,视觉AI会怎么改变你的生活?

别再想“AI识图”这种老概念了。真正落地的,是这些场景:

- 家政机器人:不再靠预设路径,而是看懂你把拖鞋乱扔在沙发边,知道“这不是意外,是习惯”,主动规划清理路线。

- 医疗影像助手:不是告诉你“有结节”,而是结合病史和动态变化,说“这个阴影三个月没变,不用急,但下周复查时注意边缘是否模糊”。

- 自动驾驶:不只是避让行人,而是判断“那个骑车的人在看手机,他下一秒可能突然拐弯”。

- 短视频剪辑:你拍了一段孩子跑向镜头的视频,AI能自动识别高潮帧、匹配节奏、删掉抖动段落,甚至建议加个慢动作——不是因为算法“觉得好看”,是因为它知道你之前80%的视频都这么剪。

视觉智能不再追求“多准”,而是追求“多有用”。它不再是一个冷冰冰的识别器,而是一个能看懂情境、理解意图、做出判断的伙伴。这不再是技术的升级,是机器从“工具”变成“协作者”的开始。