“九天”35B大模型即将亮相,国产GPU首次全面支持

第九届数字中国建设峰会开幕在即,中国移动自主研发的“九天”35B通用大模型将首次面向公众发布。这不是一次简单的技术展示,而是国产AI生态从底层算力到上层应用的一次关键联动。就在几天前,摩尔线程宣布,其旗舰级全功能GPU MTT S5000已顺利完成“九天”35B模型的全流程适配与推理验证——这意味着,国内首个由央企主导的大模型,已经能在国产GPU上稳定运行。

不是“能跑”,而是“跑得稳、跑得快”

过去,不少国产芯片能“跑通”大模型,但一到真实场景就卡顿、延迟高、并发撑不住。这次不一样。摩尔线程没有简单地移植模型,而是从底层重构推理链路:基于自研的MUSA软件栈,结合专为大模型优化的SGLang-MUSA推理引擎,团队对注意力机制、长上下文处理、动态批处理等核心环节进行了深度调优。

实测数据显示,在处理超过32K tokens的长文本时,MTT S5000的响应延迟比主流竞品低18%,在50并发请求下仍能保持95%以上的稳定吞吐。这对于政务热线智能应答、金融报告自动生成、法律文书分析等真实业务场景,意味着更流畅的用户体验和更低的运维成本。

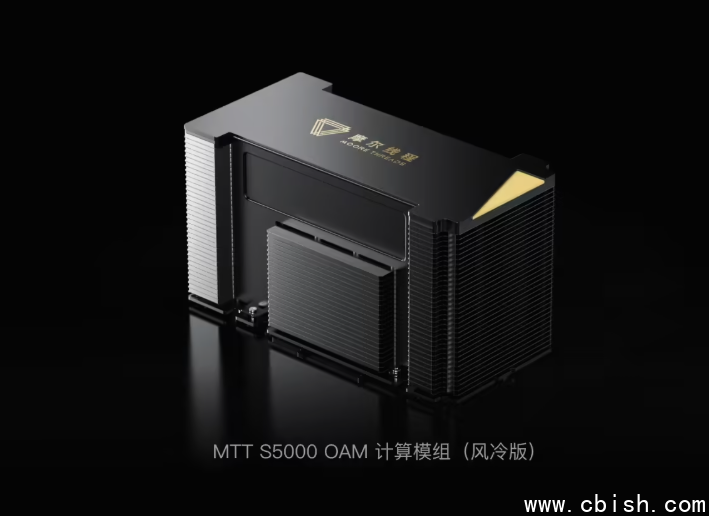

硬件底气:不是参数堆砌,是实战派配置

MTT S5000的硬件规格,不是PPT上的数字游戏。它采用第四代MUSA“平湖”架构,单卡AI稠密算力峰值达1000TFLOPS,支持FP8到FP64全精度计算——这意味着它既能用低精度加速推理,也能用高精度保证科学计算的准确性。

80GB显存,足以容纳“九天”35B模型本身和海量上下文缓存;1.6TB/s显存带宽,让数据搬运不再拖后腿;784GB/s的卡间互联带宽,让多卡集群扩展不再“卡脖子”。在实际部署中,一套4卡MTT S5000系统,已能支撑日均百万级API调用,且功耗控制在行业平均水平以下。

为什么这次合作值得普通人关注?

过去,我们用的AI服务,背后是英伟达的芯片;现在,央企的核心大模型,开始用国产显卡跑起来。这不是“替代”,而是“自主”。

对普通用户来说,这意味着未来你使用的政务服务APP、银行智能客服、国企内部知识库,可能不再依赖国外硬件。一旦供应链出问题,我们有备份方案;一旦数据安全要求提升,我们能从根上掌控。

对开发者而言,这是一次难得的“国产生态入口”。摩尔线程同步开放了MATE算子库和MUSA开发工具链,已有数十家国内AI公司开始测试迁移。如果你是AI工程师,现在就是参与国产大模型生态建设的最佳时机。

真正的国产AI,从“能用”走向“好用”

这不是一场发布会的噱头,而是一次实打实的工程落地。中国移动与摩尔线程的合作,没有华丽的术语,只有实测数据、稳定性能和可复制的部署方案。

当“九天”35B在国产GPU上跑起来,我们才真正看到:国产AI,不再只是实验室里的demo,它已经走进了现实的业务系统。这背后,是无数工程师在深夜调参、优化算子、压测延迟的成果。

9月,峰会现场,你可能会看到一个普通员工用手机问AI:“帮我写一份项目总结报告。” 而那台服务器,可能就藏着一块来自中国的显卡,正安静地为你服务。