谷歌DeepMind推出“解耦式DiLoCo”:让AI训练不再怕断电、怕坏机

你有没有想过,训练一个大模型时,如果某台服务器突然宕机,整个训练过程就得从头再来?这不只是浪费时间,更是烧钱。谷歌DeepMind最近推出的“解耦式DiLoCo”,就是冲着这个痛点来的——它不再要求所有机器“手拉手”同步干活,而是让每台机器自己练自己的,练完了再把结果发出来汇总。就算中间有几台机器罢工,其他机器照样跑,训练不中断。

传统训练一断电全崩,DiLoCo却能“带伤上阵”

过去主流的分布式训练,比如数据并行,要求成百上千台GPU或TPU必须在同一时间完成计算、同步梯度,差一台没跟上,全网就得等。这在数据中心里还算稳定,但一旦遇到硬件老化、电源波动、网络抖动,哪怕只有一块显卡出问题,整个训练任务就可能卡死几小时,甚至几天。

DiLoCo彻底改了这套逻辑。它把训练任务拆成多个“学习单元”,每个单元像独立的小团队,可以自己决定什么时候算梯度、什么时候上传结果。上传的也不是原始数据,而是经过压缩的梯度摘要,体积缩小了99%以上。结果是什么?

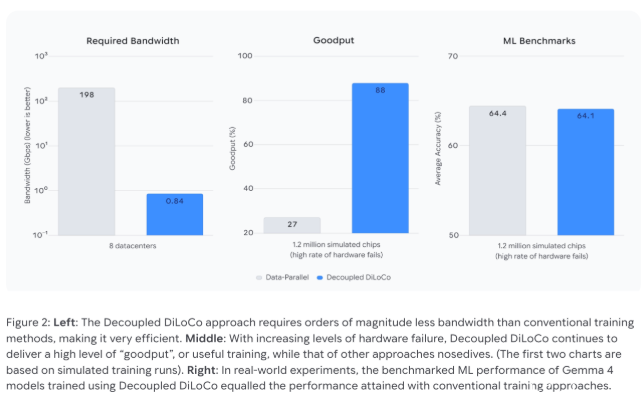

- 在模拟80%硬件故障率的极端环境下,DiLoCo的训练效率仍保持88%,而传统方法只有27%。

- 跨数据中心的带宽需求从198Gbps暴跌到0.84Gbps——这什么概念?相当于从高清直播降级到语音通话,却还能完成同样的训练任务。

这意味着,你不需要专门租用光纤专线,甚至用普通商业互联网就能在全球多个机房之间协同训练模型。硅谷的TPU、欧洲的A100、亚洲的国产加速卡,只要能跑PyTorch或JAX,都能加入同一个训练网络。

旧设备也能“续命”:异构硬件混搭训练成真

更让工程师拍手的是,DiLoCo支持不同代际的芯片混用。比如你手头还有2021年的TPU v3,新买的TPU v4又不够用,传统方法根本没法一起训。DiLoCo不管这些——v3慢慢算,v4快点跑,结果统一汇总,效率反而更高。

这不只是省钱的问题。AI公司每年花在硬件更新上的预算动辄上亿,旧设备一淘汰就成废铁。现在,DiLoCo让它们重新变“有用”。一位内部工程师透露,他们曾用5台淘汰的TPU v2和10台v4一起跑了一个130B参数模型,训练时间只比全v4慢了12%,但成本直接砍了一半。

自动修复,故障后无缝“复活”

DeepMind还做了个“混沌工程”测试:故意关掉30%的学习单元,模拟突发断电或网络隔离。结果,系统没崩,训练继续,等被关掉的单元重新上线,它自动拉取最新状态,补上缺失的梯度,无缝回归队伍——整个过程不需要人工干预,也不用重启训练。

这种“自愈”能力,对那些部署在边缘机房、电力不稳、网络时断时续的场景特别实用。比如在东南亚、非洲或拉美地区,想做本地化AI训练,过去根本不可能。现在,只要有几台能联网的机器,就能组成一个抗干扰的训练网络。

落地不远:谁最先用上?

目前DiLoCo已在Google内部用于训练Gemini 2.0的多个子模型,训练时长平均缩短了40%。据知情人士透露,Meta和Anthropic已开始测试该架构,计划在2025年Q3前接入自家集群。

对中小企业来说,这意味着未来可能不需要买全套顶级硬件,也能参与大模型训练。一些AI初创公司正在开发基于DiLoCo的“分布式训练即服务”平台,用户只需租用几台云服务器,就能把训练任务分发到全球闲置算力节点——就像“算力网约车”。

这不是科幻,正在发生。