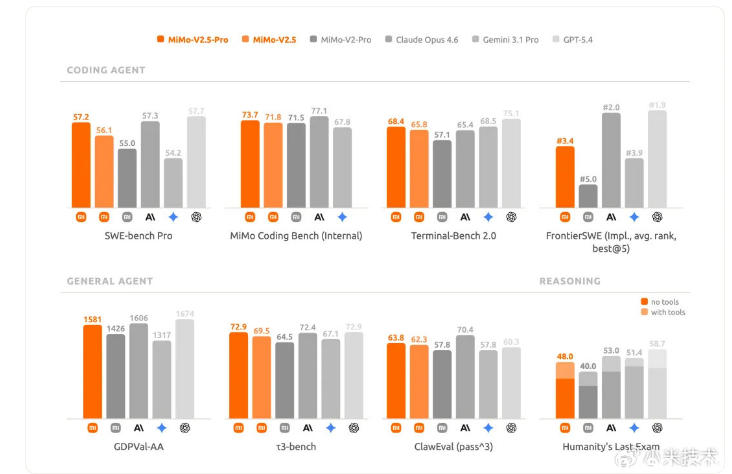

小米正式开放MiMo-V2.5系列大模型公测,性能、效率、价格全面升级

今天,小米正式宣布其自研大模型 MiMo-V2.5 系列开启公测,包括 MiMo-V2.5、MiMo-V2.5-Pro,以及配套的语音识别(ASR)与语音合成(TTS)模块。这不是一次简单的版本更新,而是一次从“能用”到“真好用”的全面跃迁。无论是开发者、内容创作者,还是普通用户,现在都能免费体验到接近顶尖水平的AI能力。

MiMo-V2.5-Pro:能写代码、能编译系统,不是演示,是真能干活

如果你以为AI助手只能写点文案、答个问题,那MiMo-V2.5-Pro会让你重新认识什么叫“智能体”。

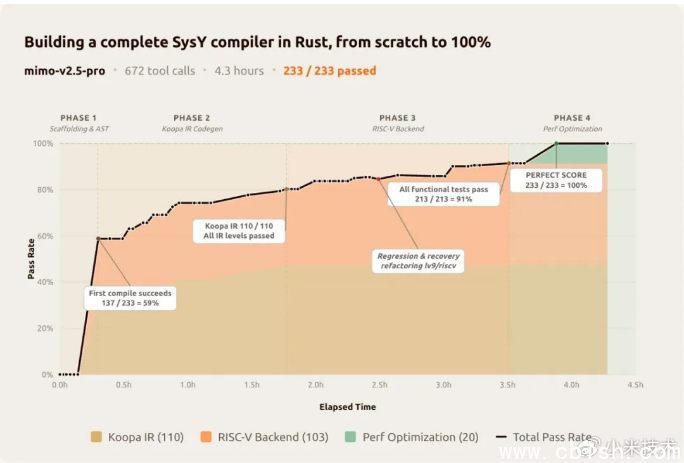

在一项真实编译器开发测试中,它用不到5小时,调用工具672次,独立完成了一个完整的SysY编译器,233个测试用例全部通过——没有人工干预,没有人工修改。这不是模拟,是实打实的工程能力。

更惊人的是,它还靠一条简单指令:“帮我做个支持多轨道时间线的网页视频编辑器”,花了近1900次调用,自己写出了8192行代码,最终跑出了一个可交互的前端应用。开发者们已经在GitHub上测试了这个项目,有人反馈:“界面简洁,功能完整,连拖拽时间轴的动画都流畅。”

这不是炫技。它意味着:你不再需要雇一个前端+后端团队来搭原型,一个指令,就能生成可用的代码框架。对独立开发者、初创团队来说,这省下的不仅是时间,更是成本。

MiMo-V2.5:看得懂视频,听得清语音,用得更省

如果你不写代码,但每天要处理视频、音频、图表,MiMo-V2.5会是你的新助手。

它能直接看懂一段10分钟的会议录像,自动提取关键发言、生成摘要,甚至标注出谁说了什么。在图表识别上,它能从截图中读出折线图趋势,说出“第三季度营收增长17%,但成本上升更快”,而不是只告诉你“这是一张图”。

更重要的是,它特别“省”。在处理同样长度的文本和图像混合任务时,它的Token消耗比Kimi、Muse等主流模型低了近一半。这意味着:你花同样的钱,能问更多问题、传更多文件、用更久。

一位自媒体创作者实测后说:“以前用别的模型分析视频,10分钟的素材要拆成5段,每段都要单独问。现在直接丢进去,一分钟内就出完整脚本和字幕。”

收费模式大调整:用得越多,越便宜

这次小米没玩“高门槛收费”,反而主动让利。

- 取消了256k和1M上下文的价差——你用1M,和用256k一样按1倍计费(V2.5);Pro版按2倍,但性能翻倍,性价比反而更高。

- 每天凌晨0点到8点,所有调用享8折,深夜写代码、做剪辑的用户,省得更多。

- 新推出连续包月/包年计划,包年比单月便宜近40%。

- 最关键的是:截至4月22日前的老用户,所有剩余积分全部清零重置,相当于白送一次“新用户福利”。

这不是“割韭菜”的套路,而是小米在用真实成本换用户信任。有开发者在社区留言:“我本来准备用GPT-4o,现在决定先用MiMo跑完项目,真香。”

即将开源,全球可用

小米技术团队已确认,MiMo-V2.5系列将在未来两个月内开源,代码、权重、训练方法都将公开。这意味着:你不仅能用,还能改、能跑在自己的服务器上,甚至做二次开发。

从2.0发布到2.5上线,小米只用了不到一个月。这在AI行业几乎是“疯狂”的速度。要知道,其他厂商还在为模型微调发愁,小米已经能跑出能写编译器的版本了。

目前,所有用户均可通过 MiMo Studio 免费体验。无需邀请码,注册即用。移动端App也将在下周上线,支持小米手机直连语音交互。

这不是一场发布会,而是一次技术平权。小米正把原本属于大厂的AI能力,一点点交到普通人手里。