从13人团队到图像革命:GPT Image2是如何悄悄改变AI绘画的

去年冬天,一张海报在推特和微博上疯传:画面是孟加拉语写的“春天来了”,字体优雅地缠绕在樱花枝头,背景是晨光透过窗棂的光影——没人相信这是AI画的。直到作者陈博远在直播中当场输入:“用韩文写‘风停了’,字体像被雨打湿的宣纸,背景是首尔老城区的雨后巷子”,不到五秒,画面生成,全场寂静。

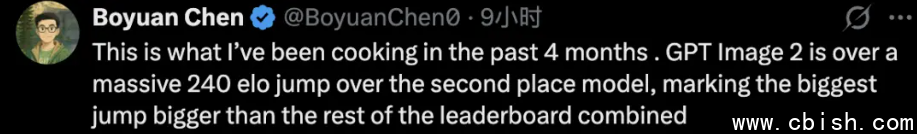

这不是什么大厂官宣的重磅产品,而是一个只有13个人的团队,在不到四个月里,把整个图像生成系统从头重写的成果——GPT Image2。没有发布会,没有融资新闻,甚至没有官网。他们只在GitHub悄悄更新了代码,然后看着用户自发地把生成图发满全网。

团队里没人提“颠覆”“革命”这种词。但你只要试过让其他AI画一个“下午3点17分的钟表,指针微微歪斜,表盘上有三道被指甲划过的痕迹”,就会明白什么叫“终于有人听懂了我在想什么”。

陈博远:那个高中时连Python都不会的天才

陈博远不是那种典型的“AI大神”形象。他穿旧球鞋,爱喝便利店咖啡,LinkedIn上只写了一句:“我做的东西,别人用着舒服,我就开心。”

读博时,他写过一个叫“Diffusion Forcing”的方法——简单说,就是不让模型“猜”图,而是教它像人类一样“一步步推演”:先想结构,再想光影,再想细节。这个思路后来被Google用在了Gemini 2.0里,但没人知道是他做的。

更让人意外的是,他高中参加科研营时,连Python都不会写。当时他用Excel做图像模拟,被老师笑称“原始人”。可他后来在OpenAI主导了GPT图像模型的全部训练,还同时是Sora视频团队的核心成员。有人问他怎么做到的,他只说:“我只是不想让AI画出‘永远10:10的钟’。”

现在,他每天早上六点起床,打开模型,输入一句:“画一张我奶奶家老式挂钟,指针停在8:43,玻璃上有裂纹,右边放着半杯凉茶。”——然后盯着看三分钟。他说:“如果它画得对,我就去吃早餐。画错了,就重来。”

不只是会画字:它懂时间、空间,和人的记忆

中科大的Jianfeng Wang负责的“世界理解模块”,是GPT Image2真正破圈的关键。

过去,AI画钟表,永远是10:10——因为训练数据里,广告商最爱用这个角度,显得“对称、好看”。但新模型知道,你家厨房的钟,可能因为电池快没电,秒针跳得一卡一卡;你办公室的挂钟,可能被阳光晒得褪了色,数字模糊了两个。

有人测试:输入“画一个地铁站出口,阳光从东边斜照进来,影子拉得特别长,地面有三片落叶,其中一片被踩了一半”。模型不仅准确还原了光影角度、落叶位置,连踩痕的纹理都像真实踩过的样子。

“这不是‘理解指令’,”Jianfeng说,“是理解人怎么观察世界。”

团队里有人做过一个实验:让模型根据老人口述,画出他1987年住过的老屋。老人说:“窗户左边有棵树,树下有张铁椅子,椅子腿断了一根,用铁丝绑着。”模型画出来后,老人哭了——和记忆里一模一样。

论文变PPT?浙大博士的“懒人神器”

浙大竺可桢学院的Yuguang Yang,是团队里最“功利”的人。

他不爱写论文,但爱做PPT。于是他做了个功能:把一篇30页的学术论文,拖进去,十秒后,自动生成一套结构清晰、配图精准、数据可视化完整的汇报幻灯片。图表不是随便贴的,每一张都对应原文的论点,连参考文献的编号都自动对上了。

“我导师看了说,‘这比我自己做的还像样’。”Yuguang笑着说。

背后是MoE(混合专家)架构的巧妙运用——模型像一支小团队,有的专家专攻文字结构,有的专攻图表逻辑,有的专管视觉排版。它们不争功劳,只管把活干好。

现在,不少高校实验室悄悄用它做答辩准备。有人开玩笑:“以后博士毕业,可能不是看论文,是看PPT。”

他们不说话,但头像已经说了

团队成员的社交账号头像,几乎清一色换成了极简的日系贴纸:一只猫、一朵云、一个歪掉的杯子。没有Logo,没有文字,连颜色都只用灰白淡蓝。

这不是什么品牌策略。只是他们觉得,那些炫技的AI效果图,太吵了。真正的创造,不该靠“哇塞”来证明。

有人问他们下一步要做什么。没人回答。但有人发现,他们最近悄悄在测试一个新功能:输入一段语音,比如“我妈妈去年冬天做的红烧肉,锅边有点糊,香味从窗户飘出去,邻居狗叫了三声”——模型生成的图,不是肉,而是一扇窗,窗台上有一小块焦黑的锅灰,和一张被风吹到一半的狗粮袋。

他们不追求“更逼真”,而是追求“更真实”。

也许,这才是AI绘画真正的终点:不是画出你没见过的东西,而是画出你心里,那个说不清、道不明的瞬间。