AI看图能认出熊猫,却找不到它的后腿?谷歌DeepMind这次真解决了

你有没有试过问AI:“这张图里的熊猫,左后腿在哪儿?”

它可能能告诉你“这是一只正在吃竹子的熊猫”,甚至能描述它毛色、背景、姿态——但当你追问具体某一条腿的位置时,它就开始打马虎眼:“大概在下半身靠左的位置”“可能在画面右侧”……

这不是AI“笨”,而是行业长期的通病:视觉模型擅长“认出整体”,却对“精准定位”束手无策。哪怕是最先进的模型,面对细粒度的物体部位、边缘分割、微小目标,都容易“看不清、说不准”。

现在,谷歌DeepMind团队推出了一套全新方案——TIPSv2,专门攻克这个“看不见细节”的老大难问题。它不靠堆参数、不靠烧算力,而是从训练方式上“动刀子”,结果直接刷新了多项行业纪录。

反直觉发现:小模型干翻大模型

研究团队一开始想的是:参数越多,效果越好。但实验数据却让他们大吃一惊——在精细图像分割任务中,一些参数只有大模型十分之一的“学生模型”,表现居然全面碾压了那些庞大的“教师模型”。

为什么?

原来,传统训练方式会让模型只关注“被遮挡的部分”,剩下的区域“放任自流”。就像考试时只复习被划的重点,其他内容全靠猜。而“学生模型”因为训练时去掉了这种“遮盖机制”,被迫把整张图从头到尾都看一遍,反而练出了“火眼金睛”。

这个发现成了TIPSv2的核心突破口:不是要更大,而是要更“全面”。

三项关键升级,让AI“看得清、指得准”

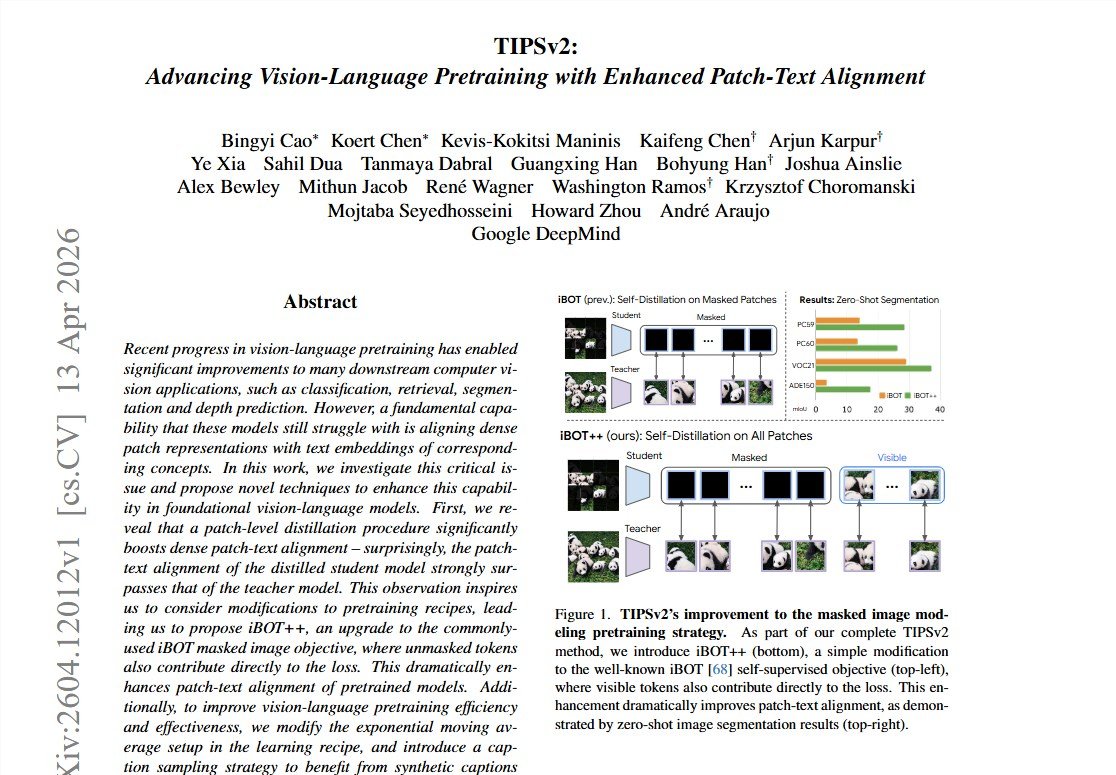

1. iBOT++:从“猜谜”升级为“全文精读”

过去,模型只对被遮住的区域做预测训练,其余部分基本是“陪跑”。TIPSv2彻底改了规则——所有可见区域,都必须精确还原。相当于你不再只背考题,而是把整本教材逐字逐句吃透。

结果立竿见影:零样本分割准确率直接提升14.1%,尤其在动物四肢、机械零件、血管分支这类细节上,识别精度大幅提升。

2. Head-only EMA:省下一半显存,性能不降

传统自监督模型要同时运行两个几乎一模一样的网络,一个“学习”,一个“稳态”,显存占用翻倍,训练成本极高。

TIPSv2发现:图文对比损失本身就能稳定主干网络,根本不需要复制整个模型。于是他们只保留投影头的“稳态版本”,主干网络直接“单打独斗”。

训练参数减少42%,显存占用大幅下降,训练速度更快,效果却几乎没损失——这对中小企业和科研团队来说,简直是福音。

3. 多粒度文本喂养:让AI学会“看细节,不偷懒”

训练时,模型不是只看“一只熊猫在吃竹子”这种笼统描述,而是随机输入三种不同粒度的文本:

- 简短描述:“熊猫,竹林”

- 中等描述:“一只黑白相间的熊猫,正用前爪抓着竹子”

- 详细描述(由Gemini生成):“左侧后腿略微弯曲,脚掌紧贴地面,毛发在阳光下呈现轻微反光,膝盖关节处有清晰褶皱”

这种“难易交替”的训练方式,逼着模型不能只记关键词,必须学会关联图像中的每一个细节。久而久之,它对“腿在哪”“边缘是否平滑”“纹理是否连续”这些事,变得异常敏感。

实测成绩:碾压大模型,开源即用

TIPSv2在9大任务、20个权威数据集上完成冻结测试(即不微调,直接用),结果惊人:

- 零样本语义分割:刷新SOTA,在动物、植物、工业部件等复杂场景中表现远超之前所有模型

- 图文检索与分类:击败参数量比它大56%的模型,说明它“更聪明,不靠堆参数”

- 纯视觉任务(如图像分类、目标检测):全面进入Top 3,性能媲美专为视觉设计的模型

特别值得注意的是,在医疗影像(如肺部结节边界)、自动驾驶(如行人脚部定位)、工业质检(如电路板焊点缺陷)等对精度极度敏感的场景中,TIPSv2的局部定位能力优势尤为明显。

已开源,马上能用

目前,TIPSv2的完整代码、预训练模型权重、训练脚本,已在GitHub全面开源:

https://github.com/deepmind/tipsv2

论文地址(已通过arXiv审核):

https://arxiv.org/abs/2604.12012

如果你是做医疗AI、自动驾驶感知、机器人视觉、工业检测的团队——别再用那些“能认出物体,但说不清细节”的模型了。TIPSv2不是又一个“炫技”项目,它是真正能落地、能提升精度、能省钱的实用突破。

现在下载,就能跑起来。