字节跳动发布全新语音交互模型 Seeduplex,豆包App已全面上线

4月9日,字节跳动Seed团队正式推出原生全双工语音大模型Seeduplex,这款模型让语音助手第一次真正“听懂了人说话的节奏”——不用等你说完再回应,而是像人与人聊天一样,边听边说,自然流畅。

目前,Seeduplex 已在豆包App全量上线,覆盖数亿用户。这不是一次小范围测试,而是从实验室走向千万人日常使用的实际落地。很多用户在使用中反馈:“它不再像机器人那样卡顿、抢话,反而像一个耐心的伙伴。”

不再“等你说完”,而是像真人一样回应

过去,语音助手大多采用“半双工”模式:你讲完,它才开口。这就像打电话时两人总在互相让话,一来一回拖慢节奏。Seeduplex 改变了这一切——它能同时处理听和说,哪怕你话没说完,它也能在你停顿的间隙插上一句“你是想问这个吗?”

实测中,它在嘈杂环境下的表现尤为突出。比如开车时导航播报和音乐混在一起,或者家人在旁边说话,它依然能准确识别你的声音和意图。误打断率和误回复率相比旧版下降了50%,不再是“你刚说一半它就答错”那种尴尬场景。

250毫秒的“呼吸感”,让对话不生硬

真正让人舒服的对话,不只靠内容,更靠节奏。Seeduplex 引入了动态判停技术,能精准判断你是真结束了,还是只是在思考。

以前,助手常常在你“嗯……”的时候就急着接话,让人觉得不耐烦。现在,它能多等250毫秒——这几乎是人眨眼的时间,却足以区分“思考中”和“说完了”。抢话的情况减少了40%,对话的自然感大幅提升。

工程上,团队用上了投机采样和模型量化技术,在保证响应速度的同时,让手机端运行更流畅。即便同时有几十人在线提问,也不会卡顿、延迟或掉线。据内部数据,用户通话满意度提升了8.34%,这是实打实的体验提升。

不只是听和说,未来还能“看”和“想”

Seeduplex 的意义,不止于语音交互更顺了。它背后是一套全新的架构:语音、语义、环境信息被统一建模,让AI不再只是“复读机”,而是能理解上下文、感知环境的智能体。

接下来,团队计划引入视觉模态。也就是说,未来的豆包不仅能听你说话,还能看你的眼神、手势、甚至房间里的光线变化。比如你一边做饭一边问:“水开了吗?”它可能通过摄像头看到锅冒蒸汽,再结合你的语音,直接回答:“锅盖在动,水快开了。”

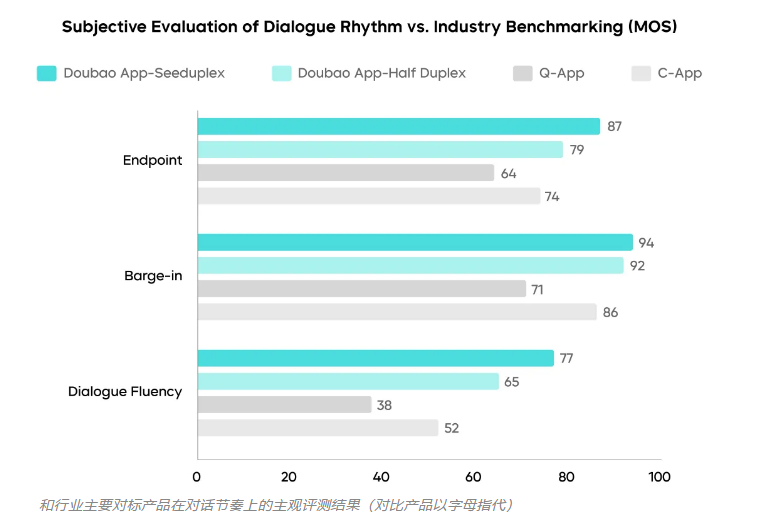

这不是科幻,而是正在发生的趋势。苹果、谷歌、Meta都在布局类似方向,但字节是目前唯一把全双工语音做到亿级用户规模的企业。Seeduplex 的上线,意味着中国AI语音交互正式进入“类人交互”时代。

现在就能体验

你不需要等更新,打开最新版豆包App,直接说话试试。不用喊“豆包”,也不用等它“滴滴”提示,随时打断、随时追问,它都会自然接住。

项目主页:https://seed.bytedance.com/seeduplex