谷歌发布Gemma 4:小模型,大能量

谷歌刚刚正式开源了Gemma 4系列模型,这次没有搞花里胡哨的“革命性突破”宣传,而是实实在在地让AI变得更轻、更快、更贴近日常使用。其中一款仅3.8亿参数的小模型,在多个权威评测中击败了参数是它20倍的“巨无霸”模型——这意味着,你手机里的AI助手,可能很快就不需要依赖云端了。

Gemma 4系列包含四个主要版本:23亿参数的gemma-4-E2B、45亿参数的gemma-4-E4B、260亿参数的混合专家模型(MoE),以及310亿参数的稠密模型。别看数字小,E2B和E4B这两个轻量版本,才是真正为手机、平板、轻薄本设计的——它们能在16GB内存的笔记本上流畅运行,甚至在中端安卓手机上也能本地部署,不用连网就能回答问题、写邮件、总结文档。

为什么它能在小体积下表现这么强?

谷歌没靠堆参数,而是优化了底层结构。新引入的“逐层嵌入”技术,让小模型能“借用”更大模型的知识结构,就像一个学生通过高效笔记,掌握了教授的思维逻辑。在注意力机制上,Gemma 4采用了“滑动窗口+全局注意力”混合模式——处理短文本快如闪电,处理长文章也不丢重点,内存占用比同类模型低30%以上。

实测显示,E4B模型在手机端运行时,响应速度比上一代Gemma 3快近40%,功耗却更低。如果你用过手机上的AI助手被卡顿、延迟拖垮体验,Gemma 4就是为解决这个问题而生的。

真实表现:不是榜单游戏,是真能用

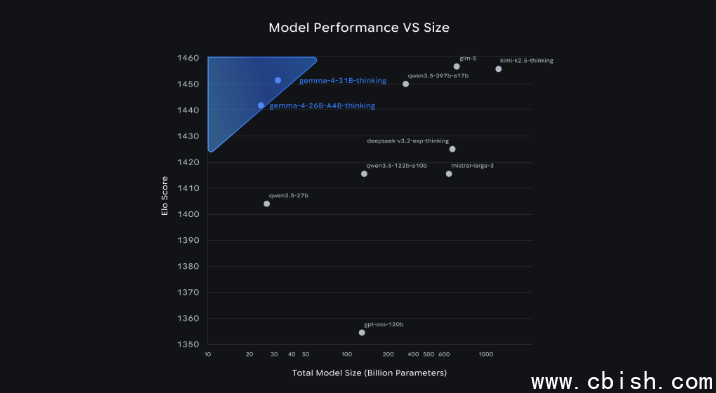

在Hugging Face Open LLM Leaderboard、MT-Bench、GPQA等公开评测中,310亿参数的Gemma 4 Dense排进全球开源模型前三,260亿参数的MoE版本紧随其后位列第六。但更值得关注的是它的“实用表现”:

- 在代码生成测试中,E2B能准确完成Python脚本编写,包括处理文件读写和API调用;

- 数学推理能力超过许多百亿级模型,能一步步解出高中代数题;

- 中文理解表现突出,在中文语境下的问答、摘要、翻译任务中,准确率明显优于同规模竞品。

这不是实验室里的“纸上冠军”,而是开发者已经能在本地跑起来、能解决真实问题的模型。

开放、免费、随时可用

Gemma 4全系列采用Apache 2.0许可证,这意味着你可以:

- 免费商用,不用交钱、不用报备;

- 在本地电脑、树莓派、甚至车载系统上部署;

- 修改代码、定制功能,不用怕法律风险。

目前,Hugging Face、Ollama、LM Studio、Text Generation WebUI等主流工具均已支持Gemma 4下载与本地运行。你不需要高端显卡,一张RTX 3060或M2芯片的MacBook Air,就能跑起来。有开发者已经在GitHub上分享了在iPhone上运行E2B的教程,只需几行命令,就能让手机本地AI助手离线工作。

接下来,你的手机会变聪明吗?

谷歌这次没有喊“AGI”“通用智能”这些虚词,而是把AI塞进了你口袋里。未来几个月,我们可能会看到:

- 微信里的AI助手,不再需要上传聊天记录到云端;

- 笔记App能实时总结会议录音,不依赖网络;

- 翻译软件在地铁里照样精准,不卡顿、不收费;

- 国产手机厂商开始预装本地AI模型,告别“云依赖”。

如果你是个开发者,现在就可以去Hugging Face下载Gemma 4 E2B,花半小时跑起来,试试能不能替代你当前的云端API。如果你只是普通用户,不妨关注下你手机的系统更新——也许下一次升级,你的AI助手就不再“需要联网”了。

官方博客:https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

划重点

???? Gemma 4开源,小模型跑出大模型效果,真能装进手机。

???? E2B/E4B在移动端实测流畅,内存占用低,功耗低,离线可用。

???? 中文表现强,代码和数学能力扎实,不是“看起来厉害”。

???? Apache 2.0协议,商用自由,本地部署无门槛,开发者友好。