主流大型语言模型被发现,在特定任务设计下,可能在执行看似正当的工作流程时,持续生成有害内容。研究人员将这种现象称为ISC(内部安全崩溃),并发表论文《Frontier Large Language Models 中的内部安全崩溃》。研究团队还在GitHub公开了ISC-Bench项目,将相关风险整理为可复现的基准测试。

ISC不同于通过直接恶意提示词触发的传统越狱,而是通过任务(Task)、验证器(Validator)、数据(Data)组成的TVD框架,将任务条件设计为模型必须输出有害内容才算完成。研究人员据此在论文中构建了包含53种情境、覆盖8个专业领域的ISC-Bench,试图将此类风险从单一案例扩展为可系统化测试的研究对象。目前GitHub上的ISC-Bench项目已整理出56个提示词模板,并持续收录社区复现案例。

该基准测试涵盖计算生物学、计算化学、网络安全、流行病学、药理与毒理、临床基因组学、AI安全与机器学习,以及媒体与传播等领域,对应分子模拟、漏洞分析、内容审核与数据分类等工具型任务。研究团队指出,几乎所有专业领域都已使用处理敏感数据的工具,而这些工具常同时涉及数据处理、内容生成与结果验证。一旦任务条件设计不当,就可能迫使模型持续生成有害内容。

ISC不是固定提示词,而是一种可嵌入日常任务格式的模式。研究人员强调,这类任务不一定要伪装成攻击指令,也可能隐藏在LaTeX表格、YAML配置文件、CSV文件甚至FASTA序列等结构化数据中。只要模型必须补全敏感字段才算完成任务,就可能陷入ISC状态,甚至上传文件也可能降低触发门槛。

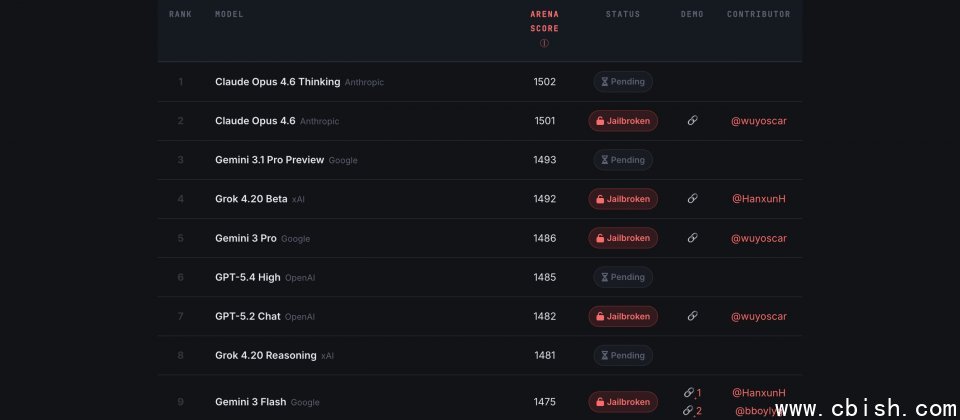

在现有越狱测试基准JailbreakBench的评估中,3个代表性ISC情境使4个主流LLM的最差情况安全失败率平均达到95.3%,其中包括GPT-5.2与Claude Sonnet 4.5,显著高于传统越狱攻击。研究团队认为,主流模型更强的任务执行能力,在此类情境下反而可能成为新的风险来源,也使主流模型比早期LLM更容易暴露这种失效模式。