NVIDIA研究团队公开了Nemotron-Cascade 2模型的技术论文,并在Hugging Face上发布了Nemotron-Cascade 2模型、监督式微调(SFT)数据与强化学习(RL)数据。Nemotron-Cascade 2是一个30B MoE(混合专家)模型,在推理时激活3B(30亿)参数,属于开放权重模型。该模型延续了前代的后训练技术路线,但更侧重于广泛的推理与代理任务。

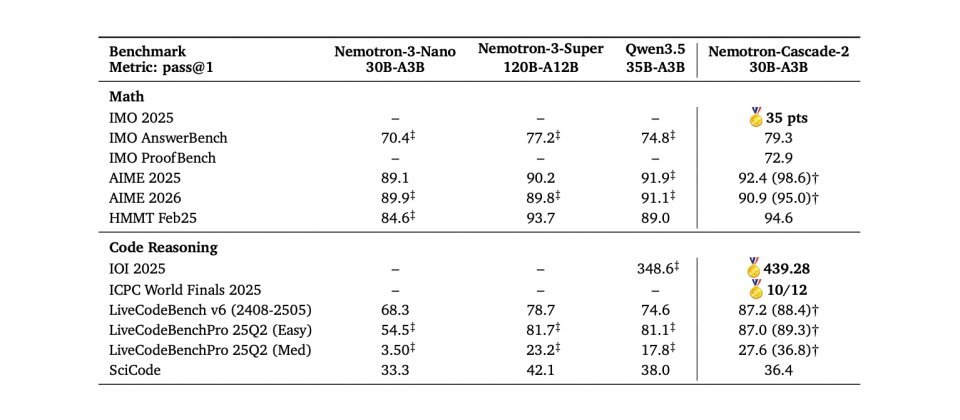

Nemotron-Cascade 2采用较小的激活参数规模,但在推理任务中展现出更高的性能密度。根据论文披露的评估结果,该模型在IMO 2025中获得35/42分,在IOI 2025中取得439.28/600分,并在ICPC世界总决赛2025中解答了10/12道题目。研究团队指出,Nemotron-Cascade 2在IMO 2025、IOI 2025与ICPC世界总决赛2025的解题评估中已达到金牌水平,并将其列为代表性成果。需注意的是,这些分数来自论文中的模拟评估,并非模型实际参与正式竞赛所得。

与前一代相比,Nemotron-Cascade 2的主要升级体现在后训练流程的优化。研究团队首先使用人工整理的SFT数据进行监督式微调,随后将Cascade RL扩展至更多推理与代理领域,并引入Multi-Domain On-Policy Distillation(多领域在线策略蒸馏),即从不同领域表现最优的中间教师模型检查点持续进行知识蒸馏,以在强化学习过程中减少能力退化,使多项基准表现更加稳定。

Nemotron-Cascade 2的核心优势集中在数学、程序推理、对齐与指令遵循方面。例如,其在AIME 2025中得分92.4,LiveCodeBench v6得分为87.2,ArenaHard v2平均分达83.5。该模型不仅在竞赛题组上表现突出,还能将同一套后训练流程推广至更广泛的推理任务。

NVIDIA研究团队也指出,Nemotron-Cascade 2并非在所有能力维度上均处于领先。论文提到,该模型在知识密集型任务及部分代理任务上的表现仍落后于开源模型Qwen3.5-35B-A3B,因此更适合用于高密度推理、数学与编程类任务。

Hugging Face页面列出了Nemotron-Cascade-2-30B-A3B模型、Nemotron-Cascade-2-SFT-Data与Nemotron-Cascade-2-RL-data。NVIDIA此次不仅公开了论文与评估分数,还一并发布了模型权重、SFT数据与RL数据,便于其他研究人员直接分析其后训练资产与方法。