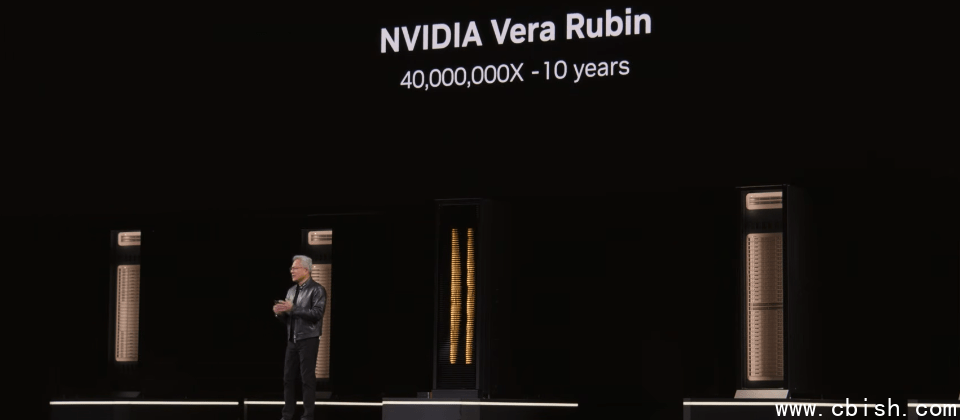

Nvidia在美国圣何塞举行的GTC 2026大会上,正式发布下一代AI基础设施Vera Rubin平台,推出7款芯片,包括Vera CPU、Rubin GPU、NVLink 6高速互联交换器、Blue Field-4 DPU、Spectrum-6以太网交换器、Connect X-9 SuperNIC及Groq 3 LPU,构建新一代AI超级计算机,满足代理式AI的AI工厂需求。

Nvidia首席执行官黄仁勋形容Vera Rubin为垂直整合、完全与软件深度协同的端到端庞大系统。因为代理AI最重要的工作负载是思考,所需的大语言模型将越来越大,产生更多词元,快速思考需要高频访问内存,以及大量结构化与非结构化数据的存取,因此需要全新设计的存储系统。

黄仁勋指出,7款芯片、5种机架设计,构成一台巨大的超级计算机,可驱动AI的每个阶段,代理AI的转折点已经到来,将由Vera Rubin推动最大规模的AI基础设施建设。

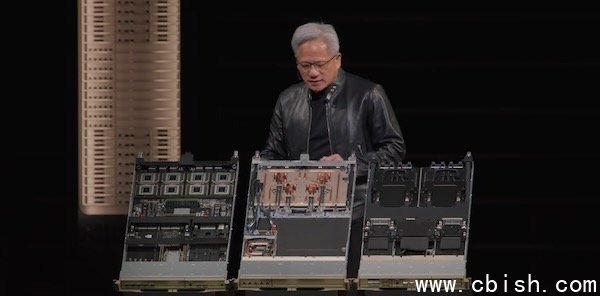

目前7款芯片已进入量产,Nvidia还发布了基于这些芯片的5种不同功能机架设计,包括Vera Rubin NVL72 GPU机架、Vera CPU机架、专用于推理加速的Groq 3 LPX机架、BlueField-4 STX存储机架,以及Spectrum-6 SPX以太网机架。

其中,Vera Rubin平台采用100%液冷设计,简化复杂布线,使用45摄氏度冷却水温,有助于减轻数据中心负荷,降低制冷成本。

Vera Rubin NVL72机架内部集成72颗Rubin GPU与36颗Vera CPU,单颗GPU可提供50 petaflops的NVFP4算力,并配备HBM4内存。

Vera Rubin NVL72机架搭配NVLink 6高速互连,以及ConnectX-9 SuperNIC、BlueField-4 DPU,加速计算性能。Nvidia强调,该机架在训练大型混合专家模型时,所需GPU数量仅为Blackwell平台的四分之一,每瓦推理数据吞吐量提升10倍,意味着每个词元的生成成本最低可降至十分之一。

Vera Rubin NVL72可通过Nvidia Quantum-X800 InfiniBand与Spectrum-X以太网扩展GPU,用于构建更大规模的AI工厂。

此外,为满足AI快速思考与处理需求,Nvidia发布全新设计的CPU——Vera CPU,内置88个Nvidia定制的Olympus核心,专为强化学习和代理AI工作负载所需的高并发CPU环境优化。

黄仁勋强调,这是专为提升单线程性能而设计的CPU,具备卓越的数据处理能力与极致的能效表现,其性能是目前其他CPU的两倍,目前已开始量产。过去Nvidia从未单独销售CPU,如今正式开启独立销售,这将成为数十亿美元的新业务。

Vera CPU机架同样采用液冷设计,基于MGX架构,内部集成256颗CPU。这些CPU拥有出色的单线程性能,并可通过Spectrum-X实现多机架互联,确保AI工厂内多CPU环境协同运行,与GPU机架共同处理大规模AI负载。

Vera Rubin结合LPU,提升万亿级参数规模的推理数据量与词元效率

Vera Rubin平台强调覆盖AI全阶段,尤其在推理所需的算力方面,推出Groq 3 LPX机架,其推理加速架构专为大上下文、低延迟场景设计。内部搭载256颗Groq 3 LPU、128GB SRAM,以及每秒640TB带宽,集群互联后可作为单一处理器加速推理。

LPX机架与Vera Rubin机架协同,用于处理万亿级参数规模的推理任务,每兆瓦推理数据吞吐量提升达35倍。此外,Rubin GPU与LPU配合,显著提升每个词元的decode效率。LPX机架预计于今年下半年上市。

Vera Rubin机架的升级版本为Rubin Ultra,采用全新Kiber机架设计,不同于Rubin,其计算节点采用垂直插入式结构,实现更高的GPU密度,单条NVLink连接下可支持144颗GPU。

在AI工厂的存储方面,Nvidia BlueField-4 STX存储机架专为AI原生架构设计,特色是将GPU内存扩展至整个POD,内部采用CPU与ConnectX-9 SuperNIC提升STX带宽,以满足LLM和代理AI工作负载产生的海量KV缓存数据,针对存储与读取进行深度优化。

STX采用专为BlueField DPU设计的DOCA Memos软件开发框架,相比通用存储方案,推理时的数据吞吐量提升高达5倍,进一步提升能效。

在AI工厂网络架构方面,Nvidia Spectrum-6 SPX以太网机架专为东西向流量设计,支持Spectrum-X以太网或Quantum-X800 InfiniBand,降低机架间延迟,提升数据传输效率,保障多GPU同步性能。

该机架采用共封装光学技术(Co-Packaged Optics, CPO)的Spectrum-X光子技术,将光引擎与交换芯片集成在同一封装内,取代传统可插拔光模块,能效比传统方案提升5倍,可靠性提升10倍。

Nvidia还发布了专为Vera Rubin设计的Vera Rubin DSX AI工厂参考设计,高度整合计算、网络、存储、供电与散热系统,从架构层面提升数据中心能效,确保AI工厂稳定运行、可扩展并最大化运行时间。

正如黄仁勋多次在不同场合强调的,在AI时代,更强大的AI基础设施将带来更高的AI工厂产出量、更快的词元生成速度,从而为厂商创造更多营收。

Nvidia目前已与Anthropic、Meta、Mistral AI、OpenAI等公司合作,使用Vera Rubin训练更大规模、更强性能的模型。该公司表示,基于Vera Rubin平台的服务器将由HP、Dell、Cisco、联想等厂商推出,华硕、富士康、技嘉也将陆续推出相关系统。