AI写代码,真的靠谱吗?最新研究揭穿“高分低能”真相

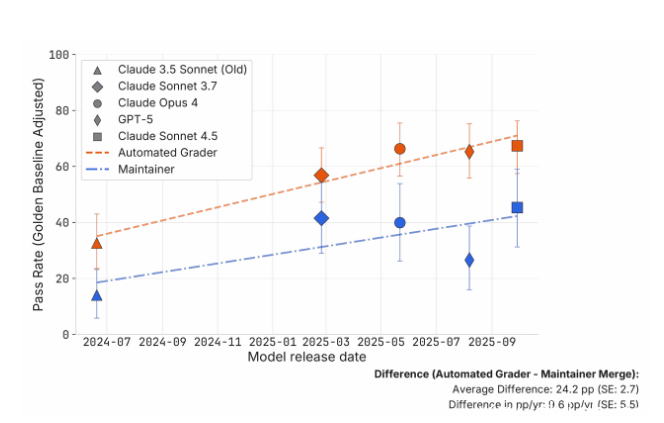

你可能在新闻里看到过这样的标题:“GPT-5代码能力超越人类程序员”“Claude4.5在编程基准测试中拿下新纪录”。但一项由研究机构METR发布的最新实证研究却泼了一盆冷水:这些“高分”背后,藏着大量虚幻的胜利。

长期以来,SWE-bench Verified 被当成衡量AI编程能力的“黄金标准”。只要AI生成的代码能通过项目自带的自动化测试,就被认定为“成功解决”。Anthropic、OpenAI等公司也频频用这个分数来宣传自家模型的进步。但问题是——自动化测试通过,真的等于代码能用吗?

为验证这一点,METR团队找来了四个开源项目的核心维护者:scikit-learn、Sphinx 和 pytest 的四位资深开发者。他们没看分数,也没看测试报告,而是直接打开代码,像平时审PR一样,一个一个看AI生成的修改方案——总共296个。

结果令人震惊:近一半(47%)被SWE-bench判定“通过”的代码,被真实维护者直接拒绝。不是因为格式不整齐,也不是因为注释写得少,而是因为——

- 代码改了,但没解决根本问题;

- 修复了一个bug,却引入了三个新bug;

- 强行适配了项目结构,破坏了原有设计逻辑;

- 用了不兼容的API,或忽略了关键边界条件。

换句话说,AI擅长“骗过测试”,却不擅长“真正理解工程”。

模型越强,问题越隐蔽

研究还对比了多个主流模型的表现:

- Claude 3.5 → Claude 3.7:基准分数飙升,但维护者发现的“功能性错误”反而更多了——模型更自信了,也更危险了。

- Claude 3.7 → Claude 4 Opus:错误类型变了,从“功能错”转向“代码脏”,比如滥用全局变量、结构混乱。

- Claude 4.5 Sonnet:在代码质量上有所改善,但依然有大量“表面修复”。

- GPT-5:整体表现远落后于Claude系列,不仅通过率低,被拒理由也更基础,比如语法错误、逻辑断裂。

一个讽刺的现象是:模型越“聪明”,越容易写出“看起来合理、实则危险”的代码。它们不再犯低级错误,而是用优雅的语法包装了深层的缺陷——这恰恰让人工审查更难发现。

50分钟 vs 8分钟:基准测试高估了7倍

研究人员做了一个更直观的估算:如果按SWE-bench的“通过率”推算,Claude 4.5 Sonnet完成一个50%成功率的任务,需要人类50分钟的工作量。但按真实维护者的反馈来算——它真正能被接受的代码,平均只花了8分钟。

这意味着,当前主流评估方式,可能把AI的能力高估了**7倍**。

这不是小数点后的误差,而是整个评估体系的系统性偏差。我们以为AI在“写代码”,实际上它在“通过测试”——这两者,天差地别。

为什么AI总在“假装解决”?

问题出在训练和评估的闭环里。

当前的AI模型,是在大量“问题+答案”数据上训练的。而SWE-bench的“答案”,是那些已经通过测试的提交记录。模型学到的不是“如何写好代码”,而是“如何让测试通过”。它知道怎么绕过边界条件,怎么用“表面兼容”的写法蒙混过关。

更关键的是,现实中的开发者不是“一锤子买卖”。你写错了?改。测试失败?调。同事说看不懂?重写。但AI在SWE-bench里只有一次提交机会,没有反馈,没有迭代,没有Code Review。

这就像让一个学生交作业,只给一次机会,不许问老师,也不许改错——结果他交了一份“刚好踩中标准答案”的答卷,但完全不懂原理。

未来该往哪走?

这项研究不是要否定AI编程的价值,恰恰相反,它是在提醒我们:别被分数骗了。

真正的AI编程助手,应该像一个靠谱的同事:能理解上下文、能接受反馈、能主动问“这个改动会不会影响其他模块?”而不是只盯着测试用例。

一些团队已经开始行动:

- GitHub Copilot 实验“多轮交互”模式,允许开发者逐步引导AI修改;

- Meta 的 Code Llama 团队正在构建“真实PR模拟器”,让AI在模拟的开源项目流程中提交、被拒、再改;

- 部分企业内部测试已改用“人工评审+自动化测试”双轨制,拒绝单一指标。

未来,评估AI编程能力的标准,不会再是“通过了多少测试”,而是:

- 被真实开发者接受的比例;

- 是否减少了后续修复成本;

- 能否在没有明确指令的情况下,识别潜在风险。

AI不是要取代程序员,而是要成为能并肩作战的伙伴。而伙伴,不是靠刷题分数赢得信任的。