WorldCompass:让AI世界模型真正“听懂”你的指令

昨天,腾讯混元3D团队正式开源了WorldCompass——一个专为世界模型设计的强化学习后训练框架。这不是又一个“参数更大、训练更久”的模型升级,而是一次对“AI到底能不能听懂人话”的根本性回应。

过去几年,世界模型越来越像一个“知识渊博但反应迟钝”的助手:你让它“拿起桌上的杯子,绕过椅子,放到窗台上”,它可能只会原地转圈,或者干脆把杯子扔到墙角。不是它不懂,而是它“学得太死”——只靠海量数据预训练,缺乏在真实交互中不断纠错、优化的能力。

WorldCompass 的出现,就是给这个“迟钝”的大脑装上了一套实时反馈系统。它不推翻原有模型,而是在预训练的基础上,用强化学习的方式,让模型在模拟环境中反复试错、自我调整。就像教孩子骑车:你不会一遍遍背诵力学公式,而是扶着他,一次次摔倒,一次次纠正。

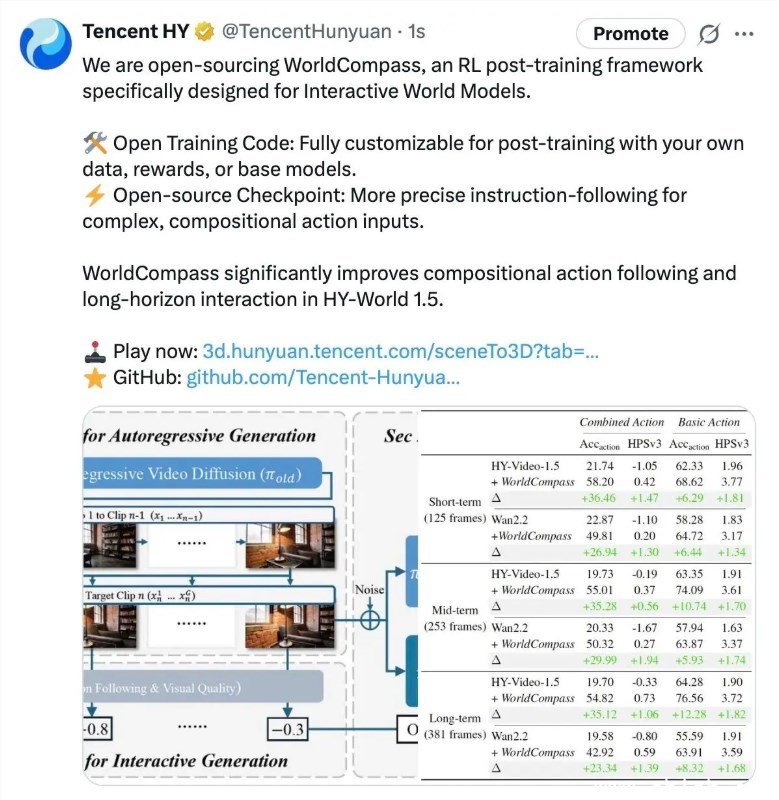

真实数据说话:准确率从20%跳到55%

腾讯没有只说“效果显著”,而是公开了实测结果。在开源模型WorldPlay上,面对最难的复合动作任务——比如“打开冰箱,取出牛奶,倒进玻璃杯,再关上门”——过去模型的执行准确率只有约20%。这意味着每五次尝试,只有一次能完整完成。

接入WorldCompass后,这个数字直接冲到了55%以上。这不是小修小补,是质的飞跃。更重要的是,这种提升不是靠“加数据”堆出来的,而是通过强化学习机制,让模型学会“看结果、改动作”。

不止动作更准了,视觉表现也稳了。在连续执行10秒以上的复杂操作时,传统模型常出现画面抖动、物体变形、光影突变等问题。WorldCompass 显著提升了HPSv3视觉保真度评分,让虚拟世界不再“卡顿出戏”,更像一个真实可交互的空间。

开源,不是口号,是行动

这次,腾讯没藏着掖着。WorldCompass 的完整代码、训练脚本、评估数据集、技术报告,全部开放在GitHub上。没有“仅限合作方”“需申请权限”这些门槛。你甚至可以直接用它去微调自己的世界模型,比如LlamaWorld、OpenSora、或任何基于Transformer的交互式模拟器。

对开发者来说,这意味着什么?

- 你可以用它让虚拟NPC更聪明地响应玩家指令,不再“卡壳”或“乱动”;

- 游戏开发者能快速构建更自然的物理交互场景,比如“推倒积木塔”“组装机械”;

- 元宇宙、数字孪生、机器人仿真等领域,终于有了一个可落地的、不靠人工规则驱动的控制方案。

我们见过太多“AI革命”的宣传,但很少有团队愿意把“调参秘方”直接摊开给你看。这次,混元团队选择做那个递工具的人。

从“看图说话”到“动手做事”

过去的世界模型,擅长的是“生成画面”——你给一段文字,它画一张图。现在,WorldCompass 带领行业走向下一个阶段:让模型“理解意图、执行动作、持续优化”。

这不是技术的终点,而是一个新起点。当AI不再只是“看懂”世界,而是能“参与”世界,虚拟世界才真正开始有生命力。

如果你正在做生成式AI、虚拟人、游戏AI、或数字孪生项目,WorldCompass 不是“可选项”,它可能是你未来半年最值得花时间研究的开源工具之一。

代码已开源,文档已齐全,剩下的,就看你的想象力了。