Phi-4-Reasoning-Vision-15B:能“自己判断该不该多想”的轻量多模态模型

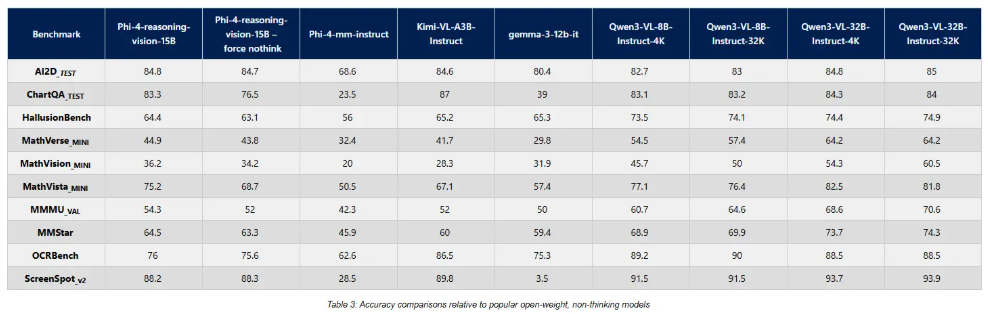

微软最近开源了一款叫 Phi-4-reasoning-vision-15B 的模型,150亿参数,不靠堆数据,也不靠超大算力,却在图像理解、界面识别和数学推理上表现得挺扎实。最特别的地方是——它不用你喊“认真点”,自己就知道什么时候该快答,什么时候该慢想。

过去我们用AI看图识物、解数学题,要么是模型一上来就胡乱推理,拖慢响应;要么是干脆敷衍了事,答得像猜谜。Phi-4-15B 换了个思路:它内部有个“判断开关”,根据输入内容的复杂度,自动决定是否启动深度推理链。比如你发一张截图问“这个按钮在哪”,它几毫秒就标出来;但如果你问“这张图里的表格和上一张图的差异在哪里,说明了什么趋势?”,它就会停下来,一步步拆解、比对、验证,再输出结果。

这个能力不是靠喊口号实现的。微软在模型架构里加了一层轻量级的“思考控制器”,训练时用的是真实用户交互数据,而不是纯人工构造的“思考-回答”对。这意味着它学的是人怎么在不同任务间切换节奏,而不是机械地模仿“深思熟虑”的格式。

不是靠烧钱训出来的

现在大模型动不动就训上万亿token,电费和算力成本高到普通团队根本玩不起。Phi-4-15B 反其道而行:只用了约2000亿高质量token,相当于GPT-4o训练量的1/50。这些数据不是随便抓的网页内容,而是来自微软内部产品的真实交互日志、教育类题目、UI设计稿标注、数学竞赛题库等,经过严格筛选。

训练过程中,GPT-4o 确实参与了辅助校准——主要是帮模型判断哪些推理路径是合理的,哪些是“看起来对其实错的”。但最终的模型参数、推理逻辑、响应节奏,全由Phi-4自己学出来。团队在论文附录里提到:“我们不是在教模型‘怎么思考’,而是在教它‘什么时候该思考’。”

谁最该关注这个模型?

如果你是开发者,想在本地跑一个能看图、能算题、还能识别网页按钮的模型,又不想买4090以上显卡,Phi-4-15B 可能是你目前能找到的少数几个“能用”的选项。

它已经开源在 Hugging Face 和 Microsoft Foundry,支持FP16和INT4量化,能在消费级显卡(如RTX 4090/3090)上流畅运行。有开发者在社区测试过,在48GB显存下,图像描述平均响应时间1.2秒,复杂数学题平均推理时间4.8秒,比同规模的Qwen-VL-1.5更稳定,误判率更低。

目前社区讨论热度确实被Qwen3.5、Llama 3.1这些“大模型”盖过了,但真正用起来的人发现:Phi-4-15B 不是炫技,是实用。它不追求“能写诗”,但能准确告诉你“这张截图里哪个按钮是提交键”、“这个公式推导有没有跳步”、“这个图表的Y轴单位是不是标错了”——这些才是企业、教育、产品测试场景里真正需要的。

现在就能试

你不需要注册任何特权账号,直接去 Hugging Face 搜索 “Phi-4-reasoning-vision-15B”,下载权重+推理代码,本地部署十分钟就能跑起来。官方还提供了几个实用示例:

- 上传一张手机App截图,自动标注所有可点击元素

- 输入一道高中数学题+手写公式图,输出分步推导过程

- 对比两张产品界面图,列出视觉和功能差异

没有花哨的宣传,没有“颠覆性革命”的标题,但如果你真的需要一个能在边缘设备上干活、不乱说话、不乱推理的多模态模型——它可能是今年最安静、也最靠谱的那个。