告别内存爆炸:长文本处理终于不卡了

你有没有试过把一份10万字的PDF塞进聊天框,结果AI卡了半分钟,电脑风扇狂转,内存直接爆表?过去,处理超长文档要么靠硬扛——用大显存堆出来一个“内存怪兽”,要么就得花几千上万块重新训练模型。现在,东京的AI初创公司Sakana AI推出两项新工具,彻底改写了这个规则。

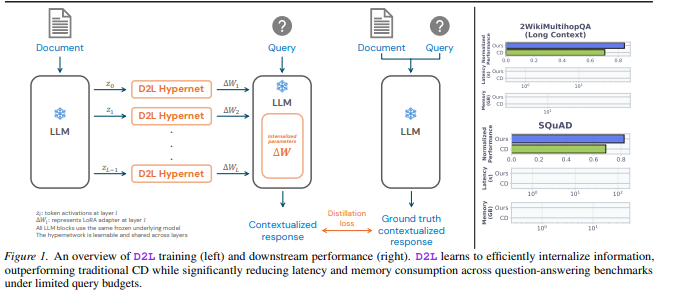

他们不靠堆硬件,也不靠重训模型,而是发明了一种“插件式”技术:你给它一篇长文,它几秒钟生成一个不到50MB的小文件,就像给AI装了个“记忆U盘”。装上它,原本只能读2000字的模型,瞬间能吃下12万字,还不卡、不慢、不烧显卡。

Doc-to-LoRA:12GB → 50MB,长文处理成本直降99%

以前处理一份12.8万Token(约十万汉字)的报告,需要一张3090甚至4090显卡,显存占用超过12GB。现在,用Sakana AI的D2L技术,只需要一个50MB的插件——比一首MP3还小。

不只是省空间,速度也快得离谱:传统方法要40到100秒“消化”文档,D2L只要不到1秒。实测中,它在“大海捞针”测试里——也就是在十万字里找一个隐藏的关键词——准确率接近100%,比人类找得还稳。

更实用的是,它兼容所有主流大模型:Llama、Qwen、Gemini,只要你能跑,就能插。企业不用买新服务器,个人开发者也能在笔记本上处理合同、论文、财报,再也不用担心“上传失败:上下文过长”。

Text-to-LoRA:一句话,让AI变专家

想让AI帮你写法律文书?做财务分析?解奥数题?过去你得找专业团队标注数据、调参、训练。现在,你只需要在对话框里打一行字:

“帮我用Excel公式分析这份销售报表,找出季度增长最慢的区域。”

系统立刻生成一个专属插件,加载后,这个AI就“变身”成你的财务顾问。实测中,它在数学竞赛题、逻辑推理题上的表现,甚至超过了那些专门训练过的专业模型。

没有训练数据?没关系。它靠的是理解你的话,而不是靠海量样本。这意味着,律师、教师、医生、程序员——任何有专业需求的人,都能用自己的语言,让AI变成自己的“私人助手”,不花一分钱训练费。

意外彩蛋:文字模型,居然能“看图”了

更让人意外的是,D2L还能“跨界”。研究人员做了一个实验:把一张猫、狗、汽车的图片,用文字描述成“一个四条腿的毛茸茸动物”“一个金属外壳的四轮机器”……然后把这些描述喂给一个从没看过图的纯文本模型。

结果?它准确识别出图片内容,准确率达到75.03%。

这不是图像识别模型,这是纯文字模型,靠的是“把图像信息翻译成文字,再塞进它的记忆插件里”。这意味着,未来你可能不需要专门的图像AI,只要给一个文字模型配个D2L插件,它就能懂图、识物、分类——省下大量算力和开发成本。

普通人也能定制AI了

过去,定制AI是大公司的专利。现在,一个高中生可以用它分析整本《资本论》;一个自由职业者能用它快速处理客户发来的几十份合同;一个小型律所,不用花十万买法律AI系统,就能自己训练一个懂合同条款的助手。

这套技术已经开源部分代码,论文也在arXiv公开(https://arxiv.org/pdf/2602.15902)。你不需要懂深度学习,只需要会用ChatGPT那样的界面,就能体验“AI随身带”的感觉。

这不是科幻,这是正在发生的现实。我们终于不用再为“AI记不住”而烦恼了——它现在,比你还记得住。