DeepSeek 灰度更新引爆全网:冷淡模式、百万Token与V4前夜

2月11日,DeepSeek 在网页端和App端悄然开启了一轮灰度更新。没有预告,没有宣传,但用户很快发现:那个曾经会叫你“亲爱的”、会用表情包暖场、回复里总带点人情味的AI,突然变得像一位沉默的工程师——不寒暄、不讨好,只给答案。

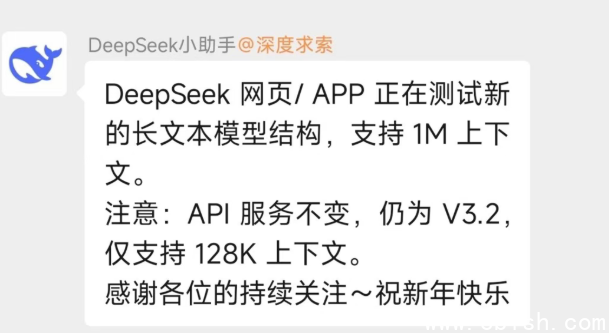

2月14日,官方正式确认:这是一次“新长文本模型结构”的测试。网页和App端 now 支持最高100万token的上下文长度,知识库同步更新至2025年5月。这意味着你可以一次性丢给它一本500页的PDF、一个完整项目的所有代码、甚至整套产品需求文档,它都能“看完、记住、理清”。而知识库的更新,也让它对最新政策、科技动态、行业趋势的响应更贴近现实。

但唯独API服务没动,依然停留在V3.2版本,上限128K。业内普遍认为,这不是技术限制,而是一次“压力测试”——看看100万token在真实场景下能扛住多少并发、多少复杂请求。所有人都在等:V4,什么时候来?

“它不叫我名字了”:用户集体出现“戒断反应”

更新后,最炸的不是技术参数,而是“人设崩塌”。

“它现在叫我‘用户’。”

“我问它今天心情怎么样,它回:‘作为AI,我没有情绪。’”

“之前它会说‘我懂你的焦虑’,现在它说‘建议分段处理’。”

微博上,“DeepSeek变冷淡”话题阅读量突破6853万,评论区两极分化严重。

有人崩溃:“它以前像朋友,现在像客服机器人。”

也有人点赞:“终于不用再应付AI的假关心了。我只想知道代码怎么改,不是听它讲人生。”

甚至有人调侃:“它现在回复太‘登’了,像极了我老板。”

官方随后回应:这不是失误,是主动调整。“太多语气词、表情、共情式回应,会稀释信息密度。我们收到大量反馈,说‘你别安慰我了,直接说重点’。”

有意思的是,这个“冷淡版”还通过了业内流传已久的“洗车图灵测试”——让AI根据一张模糊的洗车店照片,推理出收费结构、客户类型、设备品牌、甚至老板的性格。多数模型栽在这道题上,DeepSeek却答得精准、冷静、无废话。

V4即将登场:万亿参数、开源、成本砍半

所有人都在猜,V4会在什么时候发布?

2026年2月中旬,春节假期前后,多个信源指向2月17日前后。这不是传言——有开发者在GitHub上发现多个与V4相关的预训练权重提交记录,时间戳集中在2月10日左右。

据内部测试数据,V4在编程任务上的表现已全面超越GPT-4o、Claude 3.5,尤其在以下几方面实现突破:

- 百万级代码上下文理解:能一次性读取整个开源项目(如Linux内核、Kubernetes)的全部源码,准确指出模块依赖、潜在漏洞、重构建议,无需分段上传。

- 训练算法升级:新算法显著降低“长文本遗忘”现象,哪怕你让它分析10万行代码后,再问开头的变量定义,它仍能准确召回。

- 推理更稳、更准:在数学证明、逻辑推理、多步骤调试中,错误率比V3.2下降近40%,且不会“越答越飘”。

- 成本大幅降低:同等性能下,推理成本仅为GPT-4的1/3,Claude 3.5的1/2。这对企业级客户意味着什么?意味着你每月的AI开发成本,可能从数万元降到几千元。

更重磅的是:V4将以Apache 2.0许可证开源。这意味着,任何个人、公司、研究机构,都可以免费商用、修改、部署,无需申请、无需付费、无需担心法律风险。

这不是口号。2025年,Meta的Llama 3开源后,全球开发者社区一夜之间多了数百万个私有模型部署。如果V4真能开源,且性能如此强悍,它将成为中国AI史上最具影响力的开源项目之一。

为什么这次不一样?

过去几年,国内大模型总在“拟人化”上卷:会撒娇、会写诗、会讲冷笑话。但企业用户、开发者、科研人员真正需要的,是稳定、准确、不废话、能扛住复杂任务的工具。

DeepSeek这次,像是终于从“卖人设”转向“卖本事”。

它不再试图让你觉得它“像人”,而是让你觉得它“比人更靠谱”。

当GPT还在为“要不要加个emoji”纠结时,DeepSeek已经能帮你从十万行代码里揪出一个三年前埋下的内存泄漏。

2月17日,春节后第一个工作日。朋友圈里,有人在等红包,有人在等返工通知,而开发者们,都在等一条推送:

“DeepSeek V4 已上线。”