Meta 推出 SAM Audio:用“看”和“说”就能分离音频,创意工作者的革命性工具

Meta 正式在 Segment Anything Playground 上上线了 SAM Audio——一个颠覆传统音频编辑方式的 AI 模型。它不再需要你手动调参数、画频谱、设阈值,而是让你像处理图像一样“点哪分离哪”,用一句话、一个点击、一段选时,就能从混杂的音频中精准提取出你想要的声音。

三种提示方式,让音频分离像截图一样简单

SAM Audio 的核心突破,在于它融合了三种自然、直观的交互方式,彻底改变了“人机沟通”音频需求的逻辑:

- 文本提示:只需输入“去掉背景里的空调声”、“只保留左声道的吉他声”或“提取这段演讲中的笑声”,模型就能理解你的意图。无需专业术语,连非技术人员也能轻松上手。

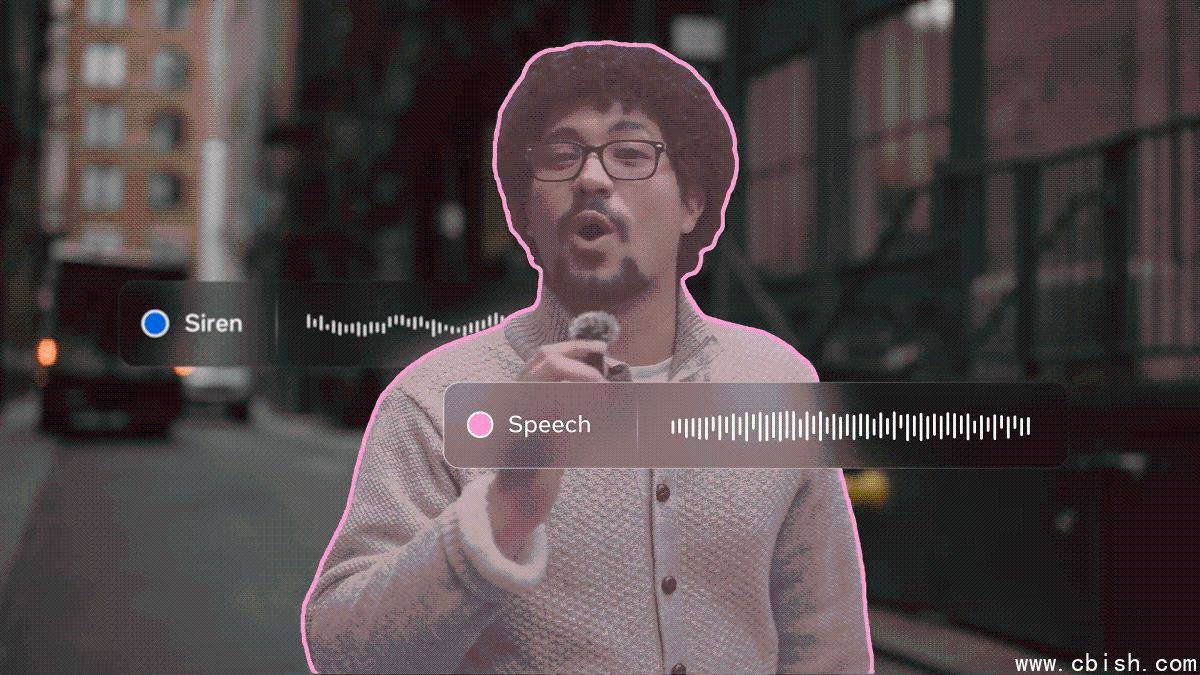

- 视觉提示:在视频画面中点击一个人、一只狗、一辆车——模型会自动关联该物体对应的音频轨迹。比如你在一段采访视频里点了一下说话者,系统立刻分离出他的声音,背景音乐和掌声自动屏蔽。这项能力对视频剪辑师简直是救命稻草。

- 时间段提示(Span Prompting):拖动时间轴,选中 0:45–1:12 这段,系统只处理这一区间的声音。这是目前主流工具(如 Adobe Audition、iZotope RX)都尚未普及的精细控制能力,特别适合处理直播回放、会议录音或长视频中的局部噪音。

这三种方式可以自由组合。比如,你可以先用视觉提示定位画面中说话的人,再用文本提示“去掉他背后的电视声”,最后用时间范围锁定他发言的整个段落——三步完成过去需要半小时的精细处理。

谁最该用它?创作者、播客、残障人士都在用

SAM Audio 不是实验室玩具,它已经面向所有人开放:

- 视频创作者:快速提取 Vlog 中的环境音、移除拍摄时的风扇噪音,甚至从街头采访中单独提取路人对话,无需重新录制。

- 音乐人:从现场录音中分离出鼓点、贝斯线,用于采样或混音重制,比传统的 AI 分离工具更准、更可控。

- 播客与自媒体:一键去除背景杂音、咳嗽声、键盘敲击,提升收听体验,节省后期时间 70% 以上。

- 听障人士与无障碍应用:系统可自动将视频中的语音转为文字并高亮显示,同时抑制干扰音,让字幕更清晰、理解更高效。Meta 已与多家无障碍组织合作,推动该功能接入辅助技术平台。

- 普通用户:想从婚礼录像里只保留孩子的笑声?想从抖音视频里提取背景音乐?现在,手机浏览器里就能操作。

目前,SAM Audio 已在 Meta Segment Anything Playground 免费开放体验,支持 Web 端直接使用,无需注册。模型也支持导出为 ONNX 格式,可部署在本地电脑、Mac 或 NVIDIA GPU 上,离线运行无隐私顾虑。

不只是工具,更是媒体编辑的“新范式”

SAM Audio 是 Meta Segment Anything 计划的自然延伸——这个计划从图像分割起步,如今已延伸至音频、视频、甚至 3D 场景。它的使命很明确:把原本属于专业工作室的复杂技术,变成人人都能随手使用的“基础能力”。

业内分析指出,SAM Audio 的出现,标志着 AI 音频处理从“自动识别”迈向“意图理解”的关键跃迁。相比 OpenAI 的 Whisper、Google 的 AudioPaLM 等仅能“听懂”语音的模型,SAM Audio 能“听懂你想要什么”,并据此执行精准操作。

据 Meta 官方透露,未来将支持多语言文本提示、实时音频流处理,以及与 Premiere Pro、Final Cut Pro、DaVinci Resolve 的插件集成。已有开发者社区在 GitHub 上开源了本地部署脚本,支持在 M1/M2 Mac 上以 20FPS 实时运行。

现在就去试试:你的一句话,可能改变一段音频的命运

无论你是想从一段家庭录像里找回孩子第一次叫“妈妈”的声音,还是想从嘈杂的咖啡馆录音中提取出一段珍贵的采访——SAM Audio 让这一切,变得比你想象中更简单。

无需学习,无需插件,打开浏览器,上传一段音频或视频,点击、打字、拖动——你,就是下一个音频编辑大师。

???? 立即体验:https://segment-anything.com/audio