The Information日前报道,Meta正式与Google协商,打算斥资数十亿美元购买Google所开发的张量处理单元(Tensor Processing Unit,TPU)。不管是Meta或Google都未回应此事,但Nvidia作出回应,表示对Google的成功感到高兴,同时强调Nvidia领先业界一个世代,仍是唯一能够在所有运算环境中完整支持并运行各种AI模型的平台。

GPU原本为加速3D图形而设计,其并行运算架构非常适合矩阵运算;Nvidia在2006年推出CUDA,首次让研究人员能够使用GPU进行科学与机器学习运算;深度卷积网络AlexNet在2012年的图像分类挑战赛ImageNet中,使用了两张Nvidia GPU进行训练,大幅降低了错误率,此后深度学习模型普遍依赖GPU进行训练与推理。

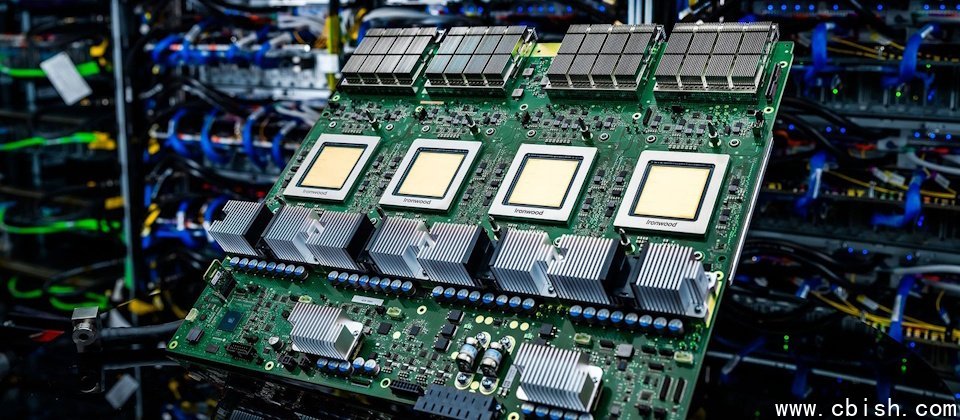

CUDA开启了GPU的通用运算时代,随着AI模型规模自2016年开始快速增长,GPU逐渐面临成本及扩展性瓶颈,市场开始发展专为AI运算设计的加速器,TPU即是Google自2015年针对AI加速所开发的定制化芯片,最初用于支持搜索及翻译等内部服务,2016年正式对外公开,并应用于Google Cloud上。

其他还包括AWS为AI训练及推理所开发的Trainium与Inferentia芯片,微软自行设计的AI加速器Maia 100,Meta开发的MTIA,且AMD及Intel也相继加入AI赛道。

上个月AI新创Anthropic宣布要大幅扩充使用Google Cloud的TPU,计划取得多达100万颗TPU的使用权,并于2026年启用超过1GW算力,预计合作金额达数百亿美元。

根据报道,Meta也打算自2027年起在自家数据中心采用Google TPU,但将先于明年租用Google Cloud的TPU。市场分析认为,若Meta与Google真能达成协议,TPU将更有机会成为Nvidia芯片的替代方案。

消息一出,Google母公司Alphabet股价连日上涨,从上周五(11/21)收盘时的299.65美元,涨到周二(11/25)的323.64美元。反之,Nvidia周二股价下滑了2.59%,跌至177.82美元。

Nvidia则在声明中表示,Google在AI领域取得长足进展,他们对Google的成功感到高兴;Nvidia领先业界一个世代,是唯一能够在所有运算环境中完整支持并运行各种AI模型的平台。相较于仅针对特定AI框架或功能设计的各类ASIC,Nvidia提供更高的性能、多功能性与更强的弹性。Nvidia并强调,将持续向Google提供产品与服务。

另一方面,Google发言人向华尔街日报(WSJ)表示,市场对Nvidia GPU及TPU的需求都在上升,该公司将同时支持两者。