OpenAI发布基于GPT-5的AI安全工具Aardvark

OpenAI周四(10/30)发布了基于GPT-5的AI安全工具Aardvark,它能像人类安全专家一样分析代码、发现漏洞并自动提出修复方案。

Aardvark的核心设计以大语言模型推理为基础,而非传统工具如模糊测试或软件成分分析。它能够理解整个代码库的架构,建立威胁模型,并通过逐行分析的方式发现逻辑错误、未完全修复的历史问题以及与隐私相关的漏洞。当代码仓库被接入后,Aardvark会先全面扫描历史记录,随后持续监控每一次代码提交,并在代码变更时实时检测新出现的漏洞。

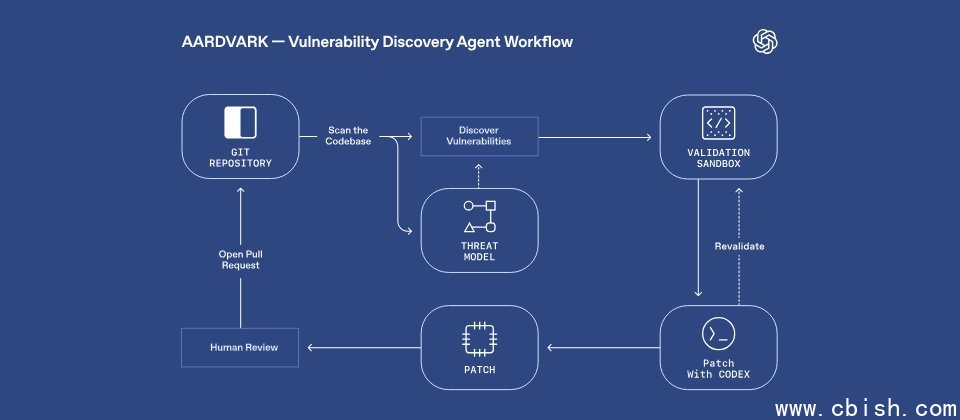

整个漏洞处理流程包含四个阶段:首先对代码库进行分析,建立威胁模型;其次对每次提交进行比对和扫描;第三步在沙盒环境中尝试实际触发漏洞,验证其可利用性并降低误报率;最后,Aardvark会通过Codex生成修复代码,并提供一键提交Pull Request的选项。OpenAI表示,这能让开发团队在不中断开发节奏的情况下快速采用高质量的修复方案。

在基准测试中,Aardvark能够识别出92%的已知及人工植入的漏洞,检测率远高于多数传统工具。OpenAI表示,Aardvark已在公司内部帮助发现多个具有实际影响的安全问题,外部测试合作伙伴也反馈该工具能发现仅在高度复杂条件下才会暴露的安全漏洞。

OpenAI也将Aardvark应用于开源领域,迄今已在多个开源项目中发现并披露漏洞,其中至少10个已获得CVE编号。未来,OpenAI将为部分非商业开源项目提供免费扫描服务。

OpenAI认为,当前所有行业都依赖软件运行,只要软件存在漏洞,就会带来产业和社会风险。仅2024年就有超过4万个漏洞被公开披露。此外,其内部测试显示,约有1.2%的代码提交会自然引入新的缺陷,这也使Aardvark被视为一种防御优先的模型,可在漏洞被利用前实现早期预警,并提供可行的修复建议。

Aardvark目前处于私有测试阶段,OpenAI正在邀请特定合作伙伴参与测试,后续将逐步扩大使用范围。