IBM发布Granite-Docling-258M小型模型,定位为端到端文档转换的视觉语言模型,采用Apache 2.0授权开源并已上架Hugging Face。官方强调这是一个针对文档转换而生的小型模型,参数量2.58亿,输出可完整保留版式、表格、数学公式、列表与代码块等结构,适合后续以RAG建立可检索的数据资产。与传统直接转为Markdown、容易与原始内容脱节的OCR流程相比,Granite-Docling的结构化输出更贴近原始文档,降低后处理不确定性。

Granite-Doclin模型与Docling库是互补关系。Docling提供可组合的文档转换软件层,能串联表格解析、数学公式与代码解析、ASR与OCR等专用模型与命令行工具,方便即插即用地整合向量数据库与代理式工作流。而Granite-Docling模型则可作为其中的单一VLM节点,一次性完成图像到结构化输出,通过单一步骤转换减少多阶段工作管线的误差累积,同时保有以Docling进行错误处理与定制化的灵活性。

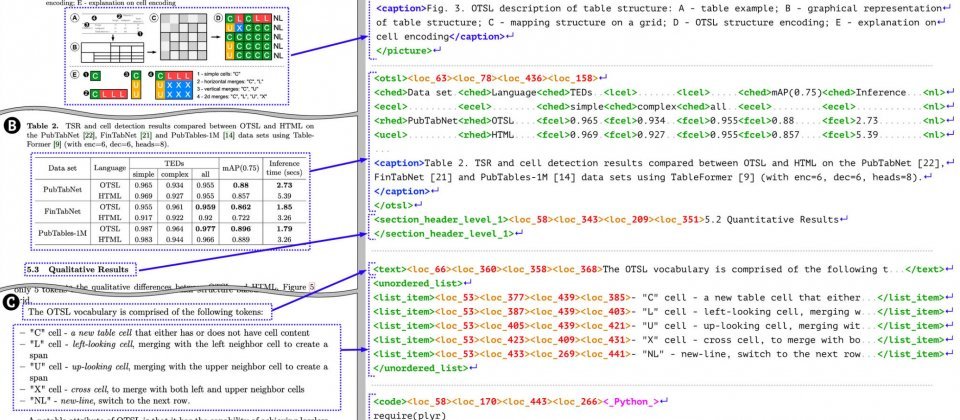

Granite-Docling的核心是DocTags,这是一套由IBM Research设计的通用文档结构标记语言,能精确描述页面元素的类型、坐标、阅读顺序与跨元素关联,例如图与其说明的对应关系。由于DocTags将内容与版式结构明确分离,模型可先界定元素范围再执行OCR,待完成转换后,DocTags可直接转为Markdown、JSON或HTML,或送入Docling库的处理流程。

此次发布被视为今年3月SmolDocling-256M-preview的产品演进,新模型以Granite3为语言骨干并采用SigLIP2视觉编码器,延续先前方法论同时提升稳定性。过去预览版偶见在页面局部出现相同Token反复出现的情形,团队此次通过数据集过滤与标注清理降低不一致样本,目标是在大量文档处理场景中维持流程稳定而不被单点错误拖累。

在语言能力方面,Granite-Docling提供对阿拉伯文、中文与日文等的实验性支持,目前尚未标示为企业级的稳定水平,后续将持续扩展语言覆盖与可靠性。IBM也同步推进docling-eval评测套件与数据集规划,计划建立标准化排行榜,以便各类文档理解方案比较。

IBM计划发展更大参数等级的Granite-Docling模型版本,但会维持在10亿参数以下以兼顾速度与硬件灵活性,并提升DocTags与IBM watsonx.ai模型的兼容性,之后也会将DocTags词汇纳入Granite的分词器(Tokenizer)与训练方案。